Яростно вкатился

чет через жопу катнул

Шапка: https://rentry.org/ex947

Прошлые треды:

https://arhivach.ng/thread/859827/

А прошлый тред где? Ссылка на шапку?

Поспешишь - людей насмешишь.

ДА ДОЛБАЁБ Я блядь

https://static.nas1.gl.arkprojects.space/stable-diff/

https://static.nas1.gl.arkprojects.space/stable-diff/

https://static.nas1.gl.arkprojects.space/stable-diff/

https://static.nas1.gl.arkprojects.space/stable-diff/

https://static.nas1.gl.arkprojects.space/stable-diff/

https://static.nas1.gl.arkprojects.space/stable-diff/

https://static.nas1.gl.arkprojects.space/stable-diff/

https://static.nas1.gl.arkprojects.space/stable-diff/

https://static.nas1.gl.arkprojects.space/stable-diff/

Я все ближе к выпуску.

Хехехе

Хехехе

Это очень хорошо. Ждёмс.

Да, надо переквалифицировать рентри

Я просто не видел или не замечаю чтоб аноны делились

Если покидаешь ссылки я добавлю

Я когда-нибудь смогу победить лору и дам фурревую. Но пока там какашка.

Там модели, датасет и все настройки есть

Время нубовопросов. Я хочу сделать несколько разных лор для обкатки и потом этих же датасетах сделать модель через дримбут. Это сработает?

Фур-анон, ты? Читал? -> https://arhivach.ng/thread/859827/#72404

Как для обкатки датасета да, вполне

Этот наш анон натренил? Прикольно. На форчке видел кто-то выкладывал

>Фур-анон, ты? Читал? -> https://arhivach.ng/thread/859827/#72404

Да, я уже тестирую другую репу.

У меня там следующие вводные:

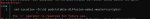

Add --network_alpha option to specify alpha value to prevent underflows for stable training. Thanks to CCRcmcpe!

Details of the issue are described in kohya-ss/sd-webui-additional-networks#49 .

The default value is 1, scale 1 / rank (or dimension). Set same value as network_dim for same behavior to old version.

LoRA with a large dimension (rank) seems to require a higher learning rate with alpha=1 (e.g. 1e-3 for 128-dim, still investigating).

Это информация кстати из репы kohya-ss, который в нашем гайде. Перешел на сторону добра?

Вкатился и укатился спать

Пытаюсь тренить нихуя tsutomu nihei, рейт результаты

анон, который тренил шоху два дня и заебался, не достигнув нужного результата

Пытаюсь тренить нихуя tsutomu nihei, рейт результаты

анон, который тренил шоху два дня и заебался, не достигнув нужного результата

Неплохое начало. Но для Нихеевских гуманоидов надо отключать фикс лиц;)

Надеюсь Сибо круто получится

Круто

Че-то всхрюкнул с dim 128.

Ну его нахуй короче...

Ну его нахуй короче...

>15793554637360.mp4

Визуализация обучения лоры

А, нет, стоп. Это автоматик походу в лужу пернул...

На стоковой модели тоже самое, только не так заметно.

Как же меня этот жопорукий мудак доебал, вы бы знали...

Никогда не поздно сделать форк

Месяц назад надо было делать, пока он еще не начал пердолить апскейлеры.

Но я разобрался. Он просто сломал latent nearest-exact.

Да, слышал у лоры проблемы с латент апскейлами. По-моему там веса применяются дважды, во время первичной генерации и в начале апскейла, что-то такое, я не разбираюсь. Можешь попробовать нативно подключить

Кстати было бы круто если в лорапомойке был список залитых файлов со ссылками. Так было бы проще заполнять репо

>Кстати было бы круто если в лорапомойке был список залитых файлов со ссылками. Так было бы проще заполнять репо

Он есть, но только у меня, кек.

Там достаточно тупой интерфейс, я специально выбирал, чтобы просто быстро работало и не пердело.

Ну да, это я натренил, сейчас допилю датасет, поставлю тренироваться и спать.

Начал перетренивать старую "поломанную" сетку с новым фиксом на абсолютно тех же настройках с тем же сидом. Посмотрим, так ли велика была потеря, и была ли вообще

>latent nearest-exact

Когда успел уже? Его ж только добавили

Вроде гены на нем нормальные, но я ниже 0.6 денойза не ставлю

>latent nearest-exact

Когда успел уже? Его ж только добавили

Вроде гены на нем нормальные, но я ниже 0.6 денойза не ставлю

Алсо было бы круто если бы можно было тренировать последовательно несколько версий с разными настройками, как с x/y grid только для тренировок

Ты сейчас про какой вид обучения говоришь?

Про любой быстрый, который может успеть полностью натренироваться за час условно

Точнее, про ВСЕ быстрые

> Про любой быстрый

Лора, либо вроде как эмбед но я их никогда не тренировал

> если бы можно было тренировать последовательно несколько версий с разными настройками, как с x/y grid только для тренировок

Есть вариант запуска сколь угодного количества обучений лор последовательно, если используешь вариант через павершелл. Я так на ночь и ставлю, у меня 7 сеток вчера стренилось

Есть тут спецы по lora?

Запилите плиз эмбеддинг Харуки Такамори по этим пикчам (обработаны вручную)

https://ibb.co/album/cX5fnt

Запилите плиз эмбеддинг Харуки Такамори по этим пикчам (обработаны вручную)

https://ibb.co/album/cX5fnt

Да с консолькой-то все понятно, хотелось бы мокропиську в интерфейс, для эмбеда в частности

А как без стороннего софта выкачать все изображения?

Алсо, плохо что без тегов, пройдусь автотеггером, но ты сам понимаешь

Беру заказ

И этот

Я удивляюсь как настолько очевидную фичу не завезли везде куда вообще можно

Ща перезалью на драйв

Ну как-то так короче...

> надо отключать фикс лиц;)

А он отключен, буквально с первого дня, после пары экспериментов с ним на аниме моделях

>Надеюсь Сибо круто получится

А вот хз, в планах вообще было надергать разворотов из блейма и абары/биомеги, там они местами очень кайфовые, не уверен вообще как выйдет, стили таки несколько разные. А с персов только общий стиль, никого конкретного. Но у меня иногда килли с сиськами выходит, лол

Сибо натренить легче наверное, чем повторить общий стиль без мешанины.

> Круто

Надеюсь эту лору не постигнет судьба шохи

Сказать-то что хотел?

Сравнить лору и dreambooth на одинаковом датасете.

Пиздец вы слепые конеш, все на месте там.

> Надеюсь эту лору не постигнет судьба шохи

Ты бля делиться будешь, шоха

> Ну как-то так короче...

Я так понял ты хотел сказать "хуйня"

> ряяяя вообщето это нечестно у них разные настройки

>Я так понял ты хотел сказать "хуйня"

Ну типа того. Не вижу особого смысла тратить на лору время, если есть нормальный датасет и vram. Не знаю, в каком месте она там "может превосходить" dreambooth, но точно не в моем.

>ряяяя вообщето это нечестно у них разные настройки

Не без этого.

>А он отключен

Я к тому, что у Нихея своя стилистика лиц, особенно для Кремниевых ребят.

> надергать разворотов

Еще бы найти чистые сканы..

>Сибо натренить легче наверное,

И еще скелет Сибо%) Как бонус

> Не вижу особого смысла тратить на лору время

Ну нам, бомжам, выбирать не приходится... Кушаем что дают, радуемся мелочам

Может у вас скрипт просто кошернее, но я уже обмяк.

Может быть. Я бы и сам гуем пользовался, если бы браузер не жрал враму. Соберись с силами и попробуй как-нибудь еще раз, но на этот раз уже с нетворк димом 512/1024 :)

Там уже по размеру полновесная модель получится, лол.

> Ты бля делиться будешь, шоха

Завтра уже, я так и не смог подружить шоху с людьми нормально, как и подружить ее со стилем оранжмикса

инб4:ты получаешь то на чем тренишь

Перегнать шоху в аниме не особо получилось

>Кремниевых ребят

С ними пока не пробовал, надо отдельный тег добавить наверное

>Еще бы найти чистые сканы..

В фш можно обрезать или клонировать, по пизде пойти не должно.

Да еще думаю можно на чанки порезать некоторые и так скормить, или все вместе, пока хз.

По-моему за пределы гига не вылезет. Не 5 же

> Завтра уже

И не только ей! Выкладывай всё что есть, будем критиковать

> Перегнать шоху в аниме не особо получилось

Да она и так прекрасна

>Перегнать шоху в аниме не особо получилось

Кстати! Крутая идея пришла. Перегнать весь датасет через какой-нибудь анимечный stylegan. Я когда-то видел один, городские пейзажи жувал на отлично

Кстати! Крутая идея пришла. Перегнать весь датасет через какой-нибудь анимечный stylegan. Я когда-то видел один, городские пейзажи жувал на отлично

Ну по факту от смены dim поменялся только стиль, с одного художника из датасета на другого. А это 10 мегабайт против 200.

Так что думаю, что пользы от гиговой модели не будет.

ing2img лучше подойдет, сделай высокий вес инита.

Странно конечно это всё. Зачарованный датасет видимо

Можешь почитать если интересно будет что эти нетворк Димы вообще делают:

https://github.com/cloneofsimo/lora/discussions/37

Там и сравнение с дримбузом, и всё-всё-всё

И можешь залить датасет куда-нибудь с референс моделью, я конечно не фуриёб, но на что только не пойдешь ради науки!

Латентный...

Держи: https://technothread.space/f.php?h=01qswOE4

Модель: https://huggingface.co/WarriorMama777/OrangeMixs/blob/main/Models/AbyssOrangeMix/AbyssOrangeMix_base.ckpt

Я тебе еще папку pnginfo сделал, куда закинул пикчи из своих сравнений , чтобы тебе над промптом не соображать.

Мужик......

Кароч сделал я сравнение с фиксом и без

И могу сказать что с фиксом моя модель нихуяшеньки ничему не научилась!

Действительно как и советуют нужно править learning_rate. Даже сам автор скрипта теперь не знает какие у него рекомендумые настройки! Это пиздец.

Веса у слоев разные, все без исключения (логично, учитывая что "поломаная" версия работает, а фиксанутая ничего не меняет). Глазами быстро пробежался – значения не сильно, но отличаются, хотя по идее должны быть совершенно разные, возможно я недоглядел. Некоторые нулевые тензоры стали ненулевыми. Это хорошо. Хотя интуиция мне подсказывала что ненулевых тензоров вообще не должно быть по определению, но я не погромист, раз умные дядьки сказали так должно работать, чтож, значит так должно работать.

И пиздец. И что делать теперь. А как тренить. Делать сетки с шагом в 0.1е-4 lr пока не получится хотя бы на уровне "поломанных" нетворков? Пиздец.

Сейчас в гайде наворотил хуйни, "ууу блядь, используйте новые настройки, если будете делать по-старому всё сломается", а в скрипте оставил 1е-4. Пиздец.

Благодарствую. Переложу тяжелую ношу экспериментирования с твоей вёрджин 4090 на мою чед 1060

И могу сказать что с фиксом моя модель нихуяшеньки ничему не научилась!

Действительно как и советуют нужно править learning_rate. Даже сам автор скрипта теперь не знает какие у него рекомендумые настройки! Это пиздец.

Веса у слоев разные, все без исключения (логично, учитывая что "поломаная" версия работает, а фиксанутая ничего не меняет). Глазами быстро пробежался – значения не сильно, но отличаются, хотя по идее должны быть совершенно разные, возможно я недоглядел. Некоторые нулевые тензоры стали ненулевыми. Это хорошо. Хотя интуиция мне подсказывала что ненулевых тензоров вообще не должно быть по определению, но я не погромист, раз умные дядьки сказали так должно работать, чтож, значит так должно работать.

И пиздец. И что делать теперь. А как тренить. Делать сетки с шагом в 0.1е-4 lr пока не получится хотя бы на уровне "поломанных" нетворков? Пиздец.

Сейчас в гайде наворотил хуйни, "ууу блядь, используйте новые настройки, если будете делать по-старому всё сломается", а в скрипте оставил 1е-4. Пиздец.

Благодарствую. Переложу тяжелую ношу экспериментирования с твоей вёрджин 4090 на мою чед 1060

А, минуту. А где дримбуз? Тот же фурслат в2? Уже снёс её

Пикрил различие между фиксом и отсутствием нетворка. Для хлебушков поясню что чёрный цвет это отсутствие всякого различия

Кохъя! Я твою мать ебал! Занёс тебя в список сразу после автоматика.

Кохъя! Я твою мать ебал! Занёс тебя в список сразу после автоматика.

Охуенно. Теперь количество эпох влияет на результат. У меня провалы каждые 115 шагов.

Я нашел прикольного автора, но у него хватит картинок, что бы лору натренировать или нет?

yoni666, якудза со свитера

У меня встал. Извинись.

yoni666, якудза со свитера

У меня встал. Извинись.

Кто-нибудь уже сделал блокнот в коллабе для тренировки лоры? Или придется самому пилить?

Если запилишь я у тебя отсосу.

Разобрался, у меня этого не было, а ниже именно оно и требовалось.

$num_epochs оставлять десятку?

Подбирай экспериментально

Ага, подобрал себе за щеку, как говорится.

Че эта хуета от меня хочет?

Хз, тут надо автора гайда ждать

Починил, там лишний слеш был в пути после конечной папки

Ну, у меня 60гб файл затребовал.

Поставь чтобы система сама подбирала себе файл подкачки.

А че так много то?

Это надо будет системный диск от говна чистить...

Хотя, le blya, мнеж теперь его всё равно чистить.

У меня 32 гб рам, своп автоматически выставился в 28 гб

Если разберусь как делать блокноты, запилю со всеми необходимыми настройками. Там чисто питон надо использовать?

Обновил скрипт, теперь вообще результата 0 на настройках анона. ЧЯДНТ?

Читай посты выше, маня

Их как собак нерезаных, форкай этот и чисти:

Не форкнется - еще принесу

Хорошо. Пойду учить питон

>ЧЯДНТ

Просто кохия все сломал, блять

И что мне делать? Если сделаю git checkout на старый коммит, то все заработает?

>Пойду учить питон

Не стоит, он сам в процессе учится. Лучше потрать время на курс ML какой-нибудь, чистое имхо.

А оно тебе надо? Залью вечером.

> кохия все сломал,

Так блядь, а нахуй я только вот ебался с установкой всего говна если нихуя не работает сука?!

Ясно, забудем про лору на месяц.

Обновил павершелл скрипт? Чтобы сымитировать старое поведение, берешь значение network_dim и ставишь его в network_alpha, чтобы были одинаковые. Все будет как раньше, если кохъя не пидорас. А он пидорас.

Ну я так, с большего. Чтоб блокнот запилить. А курс по ML таки да, хотеть, отличный совет, анон

Если сделаешь на правильный, то да.

Если тебе не нужен clip skip 2, то второй способ по гайду из шапки (на тухлой версии дополнения автоматика) должен работать.

Какой правильный?

>Чтобы сымитировать старое поведение, берешь значение network_dim и ставишь его в network_alpha, чтобы были одинаковые. Все будет как раньше, если кохъя не пидорас. А он пидорас.

У меня почти сразу в nan вчера ушло обучение с такими настройками. На новой версии.

Мужчины, не паникуем, ставим network_alpha другой и все работает как раньше. Создал ишью на гитхабе, будем разбираться. Это так оставлять нельзя.

Пиздец, это андерфлоу. Тогда чекаут на версию 0.3.2

Нам в шапку нужен золотой фонд тухлых, но работающих софтин.

На пидораса автоматика и узкоглазого кохью надежды больше нет.

Перешел на этот коммит.

>ставим network_alpha другой и все работает как раньше

Т.е. работает, но работает плохо. Нахер такое надо?

Как вот тут -

>ставим network_alpha другой и все работает как раньше

Т.е. работает, но работает плохо. Нахер такое надо?

Как вот тут -

Какой другой ставить?

Я че зря вот прямо сейчас ебался с диском и файлом подкачки чтобы пойти нахуй из за нетворк альфы? Альфы даже в нейросетях хикканов унижать чтоли будут?

> Альфы даже в нейросетях хикканов унижать чтоли будут?

А ты че там, хотел в безопасном манямирке среди тензоров схорониться, воробушек?

Ну вообще как бы да. Ладно надо посмотреть че оно там залорило

Так а что ты предлагаешь конкретно

Работает не плохо, а работает также как раньше. Обратная совместимость есть

Такой же как network_dim

>3 минуты обучения

Ничего, еще 3 минуты потерпишь

>Альфы

проиграл)

Бля, у меня уже 5 файлов скрипта разных версий и с разными настройками.

>Так а что ты предлагаешь конкретно

Найти рабочую версию скрипта и залить архив к анону

>а работает также как раньше

Его ставить равным network_dim?

>золотой фонд тухлых, но работающих софтин.

Фотошоп

>Создал ишью на гитхабе

Я как раз заглянул в твой ишью, тебе кто-то ответил, что у него все 'норм' при скорости х100. 1е-2 что ли?

Попробуй, но если loss станет nan, то добро пожаловать в клуб обезлоренных.

Можно попробовать поставить 64 или 32

Бля, вы в шары долбитесь, мужики?

Я же несколько раз уже написал

И даже в скрипте коммент напротив новой переменной, с описанием того что делать на случай, если хотите вернуть всё как было

Я же несколько раз уже написал

И даже в скрипте коммент напротив новой переменной, с описанием того что делать на случай, если хотите вернуть всё как было

nan просто раньше начинается, а генерируется мусор в жанре абстракционизма вместо картинок с первой же эпохи. То есть проблема где-то глубже.

nan просто раньше начинается, а генерируется мусор в жанре абстракционизма вместо картинок с первой же эпохи. То есть проблема где-то глубже.

>nan просто раньше начинается

Позже.

Мы не хотим вернуть, как все было. Мы хотим починеного.

Ну короче

Я чето обучил на хуй знает работает ли оно, вроде работает а вроде нихуя, вроде че то есть, а вроде и ничего нету. Пиздец.

Я чето обучил на хуй знает работает ли оно, вроде работает а вроде нихуя, вроде че то есть, а вроде и ничего нету. Пиздец.

Почему? Раньше ведь работало все нормально, зачем что то обновлять, если все работает хорошо?

Откат на версию репозитория 0.3.2

и

Удаление строчки --network_alpha=$network_alpha в павершелл скрипте, чтобы старый скрипт кохъи не ругался на несуществующие аргументы

>чтобы старый скрипт кохъи не ругался на несуществующие аргументы

Казалось бы, почему их просто не игнорировать?

Почему они выпускают в релиз версию с критическими багами?

Защита для дурака. А представь что ты опечатался в какой-то важной переменной и скрипт тебе об этом сказал

Новая версия починила критический баг, а не добавила. И не они а он. Энтузиаст. Сейчас мы разберемся с лёрнинг рейтом и всё станет ещё лучше чем было.

добро пожаловать в попенсорс

Эх, я когда писал "хотим починеного" как раз и имел в виду, что починеного Кохией в последнем коммите.

> Почему экспериментальный софт не работает идеально?

Твердо и четко?

>Новая версия починила критический баг, а не добавила.

Почему тогда раньше все работало без пердолингов с альфой и другим лернинг рейтом?

Что-то не вяжется.

> раньше все работало

Раньше было казино, в котором иногда работало, а иногда нет.

Так че делать то?

Менять альфу или не менять?

А сейчас типо постоянно работает?

Автор говорит, что да.

А рейт какой нужен?

>работает

это кохьялахта?

> Я как раз заглянул в твой ишью, тебе кто-то ответил, что у него все 'норм' при скорости х100. 1е-2 что ли?

Спасибо что заметил и сказал

Да, я примерно понял математику. Если так как он говорит то да, получается lr'ы нужно поднять в 128 раз. Сейчас поставлю тренится

Занимаюсь, ждите обновлений

Смерть.

>да, получается lr'ы нужно поднять в 128 раз

На самом времени обучении это не отразится?

Че это?

Я бы не времени обучения боялся, а того, что в шапке называется "перенасыщением"

Это график лосса

инбифо лосс жпг

Это я понял, а такой лосс что означает?

Это на 1e-2?

Это на лору чтоли? Или че ты лоссируешь то?

Это на 0.0003 128 unet_lr + 0.00005 128 text_encoder_lr

Расширение даже отказывается подгружать сетку из-за НаНов, лол.

Можно ли как-то раскрашивать чб картинки нейросетью? У меня с датасетом пизда, совсем мало картинок, хочу надергать с додзей

Знаки умножения между числами макаба потёрла

А ты подключал внешний vae при обучении?

Хммм, только что потренировал тестовую лору с --network_alpha=1 LR 1е-3 , scheduler constant, в промпте 6-7 тегов из подписей. Все вышло для одной эпохи вполне терпимо, но с редактируемостью уже проблемы. Лоси не чертил, но поглядывал в консоль, они стабильно держались в диапазоне 1.3-1.5 Еще особенность - тренировал без текстового энкодера.

Подключал

Заебись, с 3го прогона удалось че то получить похожее на хоть какой то жалкий но результат.

Лосс 1.3-1.5? У меня когда вылезает за 0.2 я паниковать начинаю.

> constant

Не ставь его с лорой, лора от этого планировщика страдает в выхлопе. Лора быстро обучается, а констант планировщик не даёт ей снизить скорость обучения со временем и всё время ебашит на максимальном значении. Попробуй перетренить на линеар например, и скажи лосс и мне про

> редактируемость

мне очень интересно

Ты пока первый у кого что-то вышло на 0.4.0

> тренировал без текстового энкодера

Хм, почему пришел к такому решению? Ты --train_unet_only пасснул?

Как посмотреть лосс когда используешь лораскрипт?

В папке sd-scripts:

.\venv\Scripts\activate

tensorboard --logdir "путь к папке с логами"

Предварительно сетка должна быть обучена с указанным logging_dir

Если хочешь чтобы можно было посмотреть с любого устройства в локальной сети добавляешь еще --bind_all

Нипанятна

В activate нет никаких tensorboard что делоть то надо?

Активировать venv командой .\venv\Scripts\activate

И выполнить команду tensorboard --logdir "путь к папке с логами"

Аа, терь понятно. Спасибо

В консоли появится ссылка

В самом тензорбоард сверху справа есть шестеренка, можно поставить автообновление, но не чаще чем раз в 30 секунд

В самом тензорбоард сверху справа есть шестеренка, можно поставить автообновление, но не чаще чем раз в 30 секунд

Я все проспал. Киньте скриншот, как там LoRA выглядит в webui. Не хочу обнов, для меня и так все нормально работает через дополнение-скрипт.

> keep_tokens N

Можно ли просчитать свое токенное слово с помощью webui и получить, например, "3" и туда его вписать, доверяя этому подсчету? Или же он считает на уровне одного слова, который разделен запятой?

Как тогда он токены перемешивает, если, например, есть теги состоящие из 3-5 токенов? Какой нибудь looking at viewer.

> keep_tokens N

Можно ли просчитать свое токенное слово с помощью webui и получить, например, "3" и туда его вписать, доверяя этому подсчету? Или же он считает на уровне одного слова, который разделен запятой?

Как тогда он токены перемешивает, если, например, есть теги состоящие из 3-5 токенов? Какой нибудь looking at viewer.

Короче ебал я в рот этого кохъю. У меня теперь ничего не работает, ни на старых, ни на новых, ни на средних

>ебал я в рот этого кохъю

База

ли прямо в промте, смотря на счетчик.

shuffle_caption не перемешивает токены, он перемешивает слова или целые словосочетания с сохраненинм последовательности отдельных слов, разделенных запятой. И

С помощью расширения Tokenize ив дальнейшем отправляется модифицированный файл описания, который токенизируется. "looking at viewer" будет в той же последовательности, что и до перемешивания, просто в цепочке токенов его токены будут в другом месте. Это позволит нивелировать так называемый "bias"

shuffle_caption не перемешивает токены, он перемешивает слова или целые словосочетания с сохраненинм последовательности отдельных слов, разделенных запятой. И

С помощью расширения Tokenize ив дальнейшем отправляется модифицированный файл описания, который токенизируется. "looking at viewer" будет в той же последовательности, что и до перемешивания, просто в цепочке токенов его токены будут в другом месте. Это позволит нивелировать так называемый "bias"

Там уже целый пантеон разработчиков с хорошими продуктами и адовыми коммитами

Что база? Удаляю гайд через 5 минут.

тю блять с телефона капчую пока тренится. В начале было про расширение tokenize, либо смотреть на счетчик в промте

Спасибо анон, даже чистить ничего не надо. Люблю такие минималистичные блокноты.

wtf, why?

Да шучу я. Тренить нехуй, посоветуйте лучше годный курс по ML где параллельно можно изучить пайтон, как анон тут сказал

Только я хлебушек. Не прям совсем-совсем, но хлебушек

Для справки: 1.41 it/s на колабовской виртуальной T4.

И за чем тогда использовать shuffle_tokens, как здесь многие рекомендуют, если он все перемешает на уровне "look 1girl viewer at ing", когда можно использовать только shuffle_caption, который рандомит лишь последовательность, а не структуру, которую ты создал через запятую?

>нехуй

Всмысле? Не тренируется же нихуя, если делать нечего, можешь брутфорсить лернинг спид

Нет такого аргумента shuffle_tokens, если я где-то такое писал, значит перепутал. Есть только shuffle_caption

1e-4 - НОЛЬ отличий

1e-3 - NaN

1e-2 - NaN

Добрутфорсился.

Жду пока ответят на гитхабе, без понятия как теперь обучать

1e-3 - НОЛЬ отличий хотел написать

и еще

3.84e-2 unet + 6.4e-4 text_encoder логично предположить что тоже нан

и еще

3.84e-2 unet + 6.4e-4 text_encoder логично предположить что тоже нан

А alpha-то? Alpha на 1?

Да нет конечно, лоси 0.13-0.15. Сглючил я, когда пост верстал.

>Не ставь его с лорой, лора от этого планировщика страдает в выхлопе

Поставил constant в тестовом режиме, чтобы исключить влияние колебаний скедьюлера на результат. Если уж ищем неизвестный ЛР, то начинать логично с постоянного рейта.

>Хм, почему пришел к такому решению? Ты --train_unet_only пасснул?

Да. Этот эксперимент вообще не связан с кохийными новведениями, просто упомянул для точности.

Я надеялся поредактировать лору в merge blocks, приварив ее к модели и избирательно возвращая обратно материнские блоки, а текстовый энкодер этому мешает.

Попробую еще потестировать вечером.

Ну, короче, я активирую shuffle_caption=1, а в keep_tokens пишут сколько токенов у меня занимает мое токенное слое (первое слово в .txt) и все заебись?

Конечно. Я не буду тренить без скалирования. Без него андерфлоу. Всё, принципиально. Починят - заебись, не починят - не буду тренить никогда лору.

МНЕ НЕ НУЖНЫ НУЛЕВЫЕ ТЕНЗОРЫ ЭТО ТРИГГЕРИТ МОЁ ОКР

Да, заебумба

> начинать логично с постоянного рейта

Действительно, я dumb

> Я надеялся поредактировать лору в merge blocks

Программист.

> Попробую еще потестировать вечером.

Ждём. Сейчас это лучшее что можно сделать

>не починят - не буду тренить никогда лору.

Базированно.

На 4090 копишь?

У меня пока нет работы, так что нет. Но когда появится...

Меня никогда ничего так не мотивировало в плане покупки видеокарты как ебаный стейбол дифьюжен. Если б у меня было дохуя денег, я бы наверное себе 4 А100 купил.

>1e-2

Спасибо, а то я хотел на этой скорости тестить.

Отдельно живешь или с родителями?

Кто там у нас заведующий?

У вас протухло.

Смотри, видимо кохъя чего-то не дофиксил, еще может зависеть от точности вычислений (или сохранения), вчера-позавчера на гитхабе был ишью по поводу опять же андерфлоу, и именно на fp16. Возможно, надо поиграться с save_precision и mixed_precision

У людей пропали проблемы с нулевыми тензорами когда они сохраняли во float

С родителями :3

А я датасет собрал, но кохья-пидор сломал мокрописю

Лучше с писей поиграться, пока узкоглазый фиксит

Вы еще посмотрите на график lr. Если он показывает действительные значения, то так быть не должно. Это cosine скедулер, откуда там появилось ебаное плато?

Переместил кохъю в списке на уровень выше.

И то верно

Переместил кохъю в списке на уровень выше.

И то верно

Ничего фиксить не собираются, у них все работает, на остальных чхать

Ну значит возвращаемся на дополнение месячной давности, там все работает.

Его, кстати, обновили недавно, угрожали все исправить. Руки еще не дошли потестить.

Проще тогда подождать пока автоматик допиит поддержку лор до нормального уровня. Исключить из списка одного рукожопа

Ты хоть репортил проблемы свои? Или ты просто в тред ноешь?

Так у него не обучение же, а использование.

Господа, у кого-нибудь остался sd-scripts предыдущей рабочей версии? Киньте архивчиком, если не сложно.

Я блядь вообще математики не выкупаю, объясните тупому. Вот я сравниваю веса старой сети и веса новой, "пофикшенной". И у их тензоров очень похожие значения. Они не отличаются в тысячи, сотни раз, ну так, на пару тройку цифр. Где-то в 1.2 меньше тензор, где-то в 1.3 больше тензор, никаких непонятных экстремальных значений нигде нет. Но "поломаная" сетка выдаёт достойный результат, полностью меняя изображение подстать датасету, а "пофикшенная" меняет буквально пару пикселей. Как блядь?

Так окрой репо, там в релизах 0.3.2/0.3.1

Так окрой репо, там в релизах 0.3.2/0.3.1

пчел, все работает на коммите от 19 января

У меня всё(почти) работает на коммите cae42728aba035a7ac305a40c75954530c3c3444

Может быть. Неделю назад нихуя не работало: https://github.com/d8ahazard/sd_dreambooth_extension/issues/763

Просто абстрактные картинки выдавало.

Ах ты ж блять, не ту ссылку нажимал, проглазоебствовал-с, прошу прощения. Спасибо. Показалось, там всё удалено кроме последнего высера.

>почти

а с чем проблемы?

Это выглядит как крайне высокий lr. Я с таким же сталкивался когда экспериментировал

Это я тренил. Коммит не скажу, но пре0.4.0 версия до альфы

Ну примерно двухнедельной давности. Но это была не lora, а dreambooth.

И настройки те же, что на версии за декабрь. Но на январской абстракционизм, на на декабрьской все норм.

>Это выглядит как крайне высокий lr. Я с таким же сталкивался когда экспериментировал

Стоковый.

>Ну примерно двухнедельной давности. Но это была не lora, а dreambooth.

>И настройки те же, что на версии за декабрь. Но на январской абстракционизм, на на декабрьской все норм.

А, я тебя не так понял.

Время нубо вопросов. Идеальный вариант лоры должен изменять картинку только по ключевому слову или лора меняет еще и теги бывшие в промте датасета?

>лора меняет еще и теги бывшие в промте датасета?

yes sir

Одно слово - это ембед

Лора добавляет веса только в те теги (токены), которые есть в датасете. Если ты назовешь тег blue eyes как-нибудь типа x_blue_eyes (о таком теге модель ничего не знает), то ты будешь тренировать этот тег/концепт с нуля. Я бы так не делал

Тоесть если у меня было имя перса и twintails в промте, то twintails тоже изменятся?

Да, я понимаю, что новые теги через датасет из 30 пикч это стремнопросто хочу понять, правильно ли составил промт.

> правильно ли составил промт

Так ты покажи

> Тоесть если у меня было имя перса и twintails в промте, то twintails тоже изменятся?

Конечно

>Конечно

Тогда все ок;)

Кстати, стоит ли vae для лоры использовать? Есть база по данному вопросу?

Я прописал, но не активировал ни разу. Привык, что раньше при обучении лучше было его выгружать.

Я прописал, но не активировал ни разу. Привык, что раньше при обучении лучше было его выгружать.

И можно ли понять лишь по loss из консоли, все ли идет так или не так?

Вроде все нормально.

Ну, поихали.

https://www.youtube.com/watch?v=rfscVS0vtbw

tl;dr: Какой VAE планируешь использовать при генерациях с этой сетью, с таким VAE и обучаешь

Полное объяснение кому интересно:

При обучении на каждом шагу сравниваются два изображения:

1. Тренировочный образец с искусственно добавленным малым количеством шума

2. Тренировочный образец с искусственно добавленным большим количеством шума, пропущенный через диффузионную модель

Перед тем, как изображение из пункта два сравнивается с изображением из пункта один, оно энкодируется в скрытое простанство, там UNet делает свои махинации по убиранию шума, шума становится меньше и VAE декодирует тензоры из скрытого пространства обратно в изображение.

Вышеперечисленной кодировкой/декодировкой занимается VAE. Диффузионная модель включает в себя встроенный VAE всегда.

VAE - это как бы тоже нейронная сеть (поправьте). Разные VAE делают это по-разному. MSE VAE от SD 1.5 лучше умеет декодировать буквы, на изображении они не такие кривые как без него. VAE от NovelAI умеет делать тонкие контуры, делать достаточно понятными глаза, волосы, но пукает в лужу когда дело доходит до повторяющихся паттернов (очень часто проебывается листва деревьев).

Как-то так. Я подключаю VAE всегда.

Нормальный лосс, не парься

https://www.youtube.com/watch?v=rfscVS0vtbw

tl;dr: Какой VAE планируешь использовать при генерациях с этой сетью, с таким VAE и обучаешь

Полное объяснение кому интересно:

При обучении на каждом шагу сравниваются два изображения:

1. Тренировочный образец с искусственно добавленным малым количеством шума

2. Тренировочный образец с искусственно добавленным большим количеством шума, пропущенный через диффузионную модель

Перед тем, как изображение из пункта два сравнивается с изображением из пункта один, оно энкодируется в скрытое простанство, там UNet делает свои махинации по убиранию шума, шума становится меньше и VAE декодирует тензоры из скрытого пространства обратно в изображение.

Вышеперечисленной кодировкой/декодировкой занимается VAE. Диффузионная модель включает в себя встроенный VAE всегда.

VAE - это как бы тоже нейронная сеть (поправьте). Разные VAE делают это по-разному. MSE VAE от SD 1.5 лучше умеет декодировать буквы, на изображении они не такие кривые как без него. VAE от NovelAI умеет делать тонкие контуры, делать достаточно понятными глаза, волосы, но пукает в лужу когда дело доходит до повторяющихся паттернов (очень часто проебывается листва деревьев).

Как-то так. Я подключаю VAE всегда.

Нормальный лосс, не парься

> VAE - это как бы тоже нейронная сеть (поправьте).

Не как бы, а прямо-таки нейросеть. Точнее две нейросети — энкодер и декодер.

Спасибо

Тогда, сколько нейросетей в себя включает sd?

Треню на 0.3.1 tokiame.

Ну тогда получается четыре, если ничего не забыл:

UNet, CLIP Text Encoder, VAE энкодер/декодер

Когда у нас будут виртуальные вайфу? С текстовой моделью уровня GPT-3, ChAI, с 2д/3д анимацией и взаимодействием в 2д/3д/vr пространстве? Сколько мне еще ждать? 10 лет? 20?

Такая тебе всё равно не даст.

На самом деле непосредственно самих нейросетей гораздо больше, потому что модель SD состоит из моделей, которые состоят из разных нейросетей и алгоритмов.

Ссылью поделишься почитать?

Кем ты работаешь?

ля какая

Зависит от моделей и смотря как тренировать..

есть ещё срырна. но чёто рисовка автора отваливается и ещё сильнее ломает анатомию и что-бы получить более-менее похожую картинку - нужно выдрачивать сфг, степы и вес лоры только для одного сида.

+хз что происходит на последних двух пиках.

Как обучал? Какие настройки? Сколько пиктч в датасете? Как тегал?

> +хз что происходит на последних двух пиках.

У лоры есть проблемы с апскейлом

К 2028 потенциал кремния упрется в тех процесс. Если не придумают что-то новое, то ВСЕ. Будем топтаться на месте и оптимизировать старое. Да и для обучения нужно слишком много энергии. 5 миллионов долларов было потрачено на электричество для обучения GPT-3, а для GPT-4 планируют 15.

В любую секунду выйдет Гретта Тунберг 2.0, скажет а хуй вам, ведь коровки дохнут, барашкам плохо на лугах пастить, о детях подумаете, за слезки тивтер_шек ответите суки вы ебанные и зарегулируют законодательно все нахуй.

Мне кажется к тому времени будет целый зоопарк из оборудования уровня 1998 года, когда всякие 3DFX живы были. Или как в 2013 с мобильными ARM чипами, только они между собой будут не совместимы совершенно. И совершенно не понятно, как простому анону все это дело обучать, ведь пока пилишь одно, уже выходит новое физическое устройство, не говоря уже о ПО, с которым мы уже сейчас сталкиваемся каждую неделю. Ничего устоятся нормально не может.

>даст

Чел, вайфу нужно не только ебать, но и любить.

+

По сути уже уперлись, прогресс ВСЁ. А текущие модели лоботомируют и дадут полнвй доступ только по подписке за 59.99$

Когда список лорок для скачки пополнится?

Тренили тут один стиль, но видно хозяевам треда он не приглянулся и они забили.

Почему это выглядит как текст, сгенерированный нейросетью? Всё, пизда, донейрогенерировался нахуй, пойду погуляю.

180пикч большинство с прозрачным фоном, лол дефолт настройки с десятью повторениями. теги из граббера.

с хайрезфиксом ты имел ввиду?

Потому что у всех "Прогресс остановится и все будет плохо" интеллект уровня генератора текстов

А на это или це не твоё? Или то же самое и всё дело в больших буферах?

> с хайрезфиксом ты имел ввиду?

Да

В чем мы не правы? По пунктам.

Ничего не могу сказать про прогресс, но открытый релиз сд был ошибкой stable ai. Больше они ее не допустят. Гой должен сидеть на подписке и жрать, что дают, а не учить свои модели и обходить цензуру.

По той же причине никогда не будет локального чата опенаи.

1 пик - мои 7 эпох

2 пик - мои 9 эпох

3 пик - модель анона-1060

версия мокрописи 0.3.1

2 пик - мои 9 эпох

3 пик - модель анона-1060

версия мокрописи 0.3.1

настройки одни и те же

По версии опять же не попал. Какая версия рабочая?

>В чем мы не правы?

>упрется в тех процесс

Во всем, начиная отсюда. Им еще далеко до предела по размеру транзисторов. Даже на одном техпроцессе можно увеличить мощность меняя компоновку и применяя новые типы транзисторов.

Не удивлюсь, если увижу проекты по обучению нейросетей через распределенные вычисления.

Достаточно сказать, что вы обучаете генератор речи для вайфу и вычислительные мощности ваши.

это моё. тренировал не персонажей, а художника, всё в одном.

последняя, но без хайреза. и это клип скип 2, хотя тренировал на 1, походу вообще эта крутилка не работает

Сейчас бессмысленно тренировать пидор ускоглазый все поломал. Пруфы выше -

> не персонажей, а художника

Так а разве граббер не будет так же захватывать и теггировать персонажей?

В чём проблема откатиться на версию, на которой всё работает?

Я не знаю, какая версия рабочая.

у меня версия 0.1, вроде не поломаная

будет, но если я треню одного перса на датасете в 200пикч лягушка, то результат будет лучше, чем датасет хуйдожника с NN числом персонажей на те-же 200 пикч.розовая хабалка

Скажи, какая рабочая?

пикрил - моя лора, уже лучше, чем ничего, немного подрочился с настройками я

но все равно дерьмо собачье по сравнению с моделью анонов, пикрил - модель фурфага

Значит ли это, что лора умерла и теперь остался только дримбут?

Видимо, именно поэтому после выпуска 1.3 была запилена еще 1.4, затем был релиз 1.5 с инпейнт-моделью, после чего была выпущена 2.0 с разрешением 768, а спустя некоторое время уже и 2.1.

>после чего была выпущена 2.0 с разрешением 768, а спустя некоторое время уже и 2.1.

Нечего больше добавить про вторую версию? Ничего не забыл?

А в третьей уже знаешь, какие интересные фичи завезут?

вот 1060-анон, лора натурально подохла и тренит на уровне эмбеддингов, спасибо кохью

>Не удивлюсь, если увижу проекты по обучению нейросетей через распределенные вычисления.

https://github.com/chavinlo/distributed-diffusion/

Скинь мне pnginfo

Ок, минуту.

Рабочий вариант натренировать сеть под определенный стиль с сохранением работоспособности апскейлеров и без необходимости отвалить ведро бабла на картонку с 48гб врам? Эмбеддинги? Или есть какой-то рабочая связка лоры+вебгуя? Картон на 8гб.

Интересно, если обучить дримбут по фото объекта на реалистичной модели и замержить с аниме моделями, то перейдет ли стиль на объект?

Вот. Только нужно еще сделать цивильное приложение для нормисов.

Вот. Только нужно еще сделать цивильное приложение для нормисов.

Лора не работает сейчас, либо выдает говно, либо не выдает ничего, либо NaN. Единственный рабочий вариант - дримбут, гугли.

>то перейдет ли стиль на объект?

Вместо объекта будет каша.

(tok:1.4), 1girl

Negative prompt: bad face, nose, bad anatomy, bad proportions, bad perspective, multiple views, concept art, reference sheet, mutated hands and fingers, interlocked fingers, twisted fingers, excessively bent fingers, more than five fingers, lowres, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry, artist name, low quality lowres multiple breasts, low quality lowres mutated hands and fingers, more than two arms, more than two hands, more than two legs, more than two feet, low quality lowres long body, low quality lowres mutation poorly drawn, low quality lowres black-white, low quality lowres bad anatomy, low quality lowres liquid body, low quality lowres liquid tongue, low quality lowres disfigured, low quality lowres malformed, low quality lowres mutated, low quality lowres anatomical nonsense, low quality lowres text font ui, low quality lowres error, low quality lowres malformed hands, low quality lowres long neck, low quality lowres blurred, low quality lowres lowers, low quality lowres low res, low quality lowres bad proportions, low quality lowres bad shadow, low quality lowres uncoordinated body, low quality lowres unnatural body, low quality lowres fused breasts, low quality lowres bad breasts, low quality lowres huge breasts, low quality lowres poorly drawn breasts, low quality lowres extra breasts, low quality lowres liquid breasts, low quality lowres heavy breasts, low quality lowres missing breasts, low quality lowres huge haunch, low quality lowres huge thighs, low quality lowres huge calf, low quality lowres bad hands, low quality lowres fused hand, low quality lowres missing hand, low quality lowres disappearing arms, low quality lowres disappearing thigh, low quality lowres disappearing calf, low quality lowres disappearing legs, low quality lowres fused ears, low quality lowres bad ears, low quality lowres poorly drawn ears, low quality lowres extra ears, low quality lowres liquid ears, low quality lowres heavy ears, low quality lowres missing ears, low quality lowres fused animal ears, low quality lowres bad animal ears, low quality lowres poorly drawn animal ears, low quality lowres extra animal ears, low quality lowres liquid animal ears, low quality lowres heavy animal ears, low quality lowres missing animal ears, low quality lowres text, low quality lowres ui, low quality lowres missing fingers, low quality lowres missing limb, low quality lowres fused fingers, low quality lowres one hand with more than 5 fingers, low quality lowres one hand with less than 5 fingers, low quality lowres one hand with more than 5 digit, low quality lowres one hand with less than 5 digit, low quality lowres extra digit, low quality lowres fewer digits, low quality lowres fused digit, low quality lowres missing digit, low quality lowres bad digit, low quality lowres liquid digit, low quality lowres colorful tongue, low quality lowres black tongue, low quality lowres cropped, low quality lowres watermark, low quality lowres username, low quality lowres blurry, low quality lowres JPEG artifacts, low quality lowres signature, low quality lowres 3D, low quality lowres 3D game, low quality lowres 3D game scene, low quality lowres 3D character, low quality lowres malformed feet, low quality lowres extra feet, low quality lowres bad feet, low quality lowres poorly drawn feet, low quality lowres fused feet, low quality lowres missing feet, low quality lowres extra shoes, low quality lowres bad shoes, low quality lowres fused shoes, low quality lowres more than two shoes, low quality lowres poorly drawn shoes, low quality lowres bad gloves, low quality lowres poorly drawn gloves, low quality lowres fused gloves, low quality lowres bad cum, low quality lowres poorly drawn cum, low quality lowres fused cum, low quality lowres bad hairs, low quality lowres poorly drawn hairs, low quality lowres fused hairs, low quality lowres big muscles, low quality lowres ugly, low quality lowres bad face, low quality lowres fused face, low quality lowres poorly drawn face, low quality lowres cloned face, low quality lowres big face, low quality lowres long face, low quality lowres bad eyes, low quality lowres fused eyes poorly drawn eyes, low quality lowres extra eyes, low quality lowres malformed limbs, low quality lowres more than 2 nipples, low quality lowres missing nipples, low quality lowres different nipples, low quality lowres fused nipples, low quality lowres bad nipples, low quality lowres poorly drawn nipples, low quality lowres black nipples, low quality lowres colorful nipples, low quality lowres gross proportions, short arm, low quality lowres missing arms, low quality lowres missing thighs, low quality lowres missing calf, low quality lowres missing legs, low quality lowres mutation, low quality lowres duplicate, low quality lowres morbid, low quality lowres mutilated, low quality lowres poorly drawn hands, low quality lowres more than 1 left hand, low quality lowres more than 1 right hand, low quality lowres deformed, low quality lowres extra arms, low quality lowres extra thighs, low quality lowres more than 2 thighs, low quality lowres extra calf, low quality lowres fused calf, low quality lowres extra legs, low quality lowres bad knee, low quality lowres extra knee, low quality lowres more than 2 legs, low quality lowres bad tails, low quality lowres bad mouth, low quality lowres fused mouth, low quality lowres poorly drawn mouth, low quality lowres bad tongue, low quality lowres tongue within mouth, low quality lowres too long tongue, low quality lowres big mouth, low quality lowres cracked mouth, low quality lowres dirty face, low quality lowres dirty teeth, low quality lowres dirty pantie, low quality lowres fused pantie, low quality lowres poorly drawn pantie, low quality lowres fused cloth, low quality lowres poorly drawn cloth, low quality lowres bad pantie, low quality lowres yellow teeth, low quality lowres thick lips, low quality lowres bad asshole, low quality lowres poorly drawn asshole, low quality lowres fused asshole, low quality lowres missing asshole, low quality lowres bad anus, low quality lowres bad pussy, low quality lowres bad crotch, low quality lowres bad crotch seam, low quality lowres fused anus, low quality lowres fused pussy, low quality lowres fused crotch, low quality lowres poorly drawn crotch, low quality lowres fused seam, low quality lowres poorly drawn anus, low quality lowres poorly drawn pussy, low quality lowres poorly drawn crotch seam, low quality lowres bad thigh gap, low quality lowres missing thigh gap, low quality lowres fused thigh gap, low quality lowres liquid thigh gap, low quality lowres poorly drawn thigh gap, low quality lowres bad collarbone, low quality lowres fused collarbone, low quality lowres missing collarbone, low quality lowres liquid collarbone, low quality lowres strong girl, low quality lowres obesity, low quality lowres worst quality, low quality lowres low quality, low quality lowres normal quality, low quality lowres liquid tentacles, low quality lowres bad tentacles, low quality lowres poorly drawn tentacles, low quality lowres split tentacles, low quality lowres fused tentacles, low quality lowres missing clit, low quality lowres bad clit, low quality lowres fused clit, low quality lowres colorful clit, low quality lowres black clit, low quality lowres liquid clit, low quality lowres QR code, low quality lowres bar code, low quality lowres censored, low quality lowres safety panties, low quality lowres safety knickers, low quality lowres beard, low quality lowres furry, pony, low quality lowres pubic hair, low quality lowres mosaic, low quality lowres excrement, low quality lowres shit, low quality lowres futa, low quality lowres testis, low quality lowres lowres, low quality lowres terrible, low quality lowres dirty, low quality lowres feces, low quality lowres organs, low quality lowres fat, low quality lowres thick thighs, low quality lowres low resolution rough, low quality lowres pedophile, low quality lowres bestiality, low quality lowres parody, low quality lowres traditional media, low quality lowres koma, low quality lowres comic, low quality lowres scary, low quality lowres severe, low quality lowres insects, low quality lowres gross scars, low quality lowres twisted human body, low quality lowres irrational human body, low quality lowres sharp fingers, low quality lowres parts of the body out of common sense, low quality lowres murder, low quality lowres beheading, low quality lowres zombie, low quality lowres mummy, low quality lowres graffiti, low quality lowres unfinished picture, low quality lowres terrible quality, low quality lowres Coprophilia, low quality lowres muscular, low quality lowres bald, low quality lowres monk, low quality lowres wrinkly, low quality lowres simple background, low quality lowres realistic, low quality lowres old, low quality lowres scan, low quality lowres touhou, low quality lowres yaoi, low quality lowres gay, low quality lowres femboy, low quality lowres trap, low quality lowres pee, low quality lowres doujinshi, low quality lowres monochrome, low quality lowres meme, low quality lowres demon, low quality lowres monstrous creature, low quality lowres tentacle, low quality lowres self harm, low quality lowres vomit, low quality lowres suicide, low quality lowres death, low quality lowres corpse, low quality lowres bone, low quality lowres skeleton, low quality lowres fingers over 6, low quality lowres framed, low quality lowres historical picture, low quality lowres futanari, low quality lowres shemale, low quality lowres transgender, low quality lowres dick girl, low quality lowres flat breasts, low quality lowres degenerate ass, low quality lowres retro artstyle, low quality lowres anime screencap, low quality lowres stitched, low quality lowres pokemon, low quality lowres ryona, low quality lowres animal, low quality lowres male focus, low quality lowres nipple penetration, low quality lowres sonic (series), low quality lowres bondage, low quality lowres bdsm, low quality lowres 2D, low quality lowres 2D game, low quality lowres 2D game scene, low quality lowres 2D character, low quality lowres game cg, low quality lowres watercolor (medium), low quality lowres 2koma, low quality lowres interlocked fingers, low quality lowres gloves, low quality lowres nitroplus, low quality lowres grayscale, low quality lowres sketch, low quality lowres line drawing, low quality lowres gorilla, low quality lowres meat, low quality lowres gundam, low quality lowres multiple views, low quality lowres cut, low quality lowres concept art, low quality lowres reference sheet, low quality lowres turnaround, low quality lowres chart, low quality lowres comparison, low quality lowres artist progress, low quality lowres lineup, low quality lowres before and after, low quality lowres orc, low quality lowres tusks, low quality lowres goblin, low quality lowres kobold, low quality lowres pony, low quality lowres nsfw, low quality lowres Humpbacked, low quality lowres text error, low quality lowres extra digits, low quality lowres standard quality, low quality lowres large breasts, low quality lowres shadow, low quality lowres nude, low quality lowres artist name, low quality lowres skeleton girl, low quality lowres bad legs, low quality lowres missing fingers, low quality lowres extra digit, low quality lowres artifacts, low quality lowres bad body, low quality lowres optical illusion, low quality lowres Glasses, low quality lowres girl, low quality lowres women, low quality lowres more than 1 moon, low quality lowres Multi foot, low quality lowres Multifold, low quality lowres Multi fingering, low quality lowres colored sclera, low quality lowres monster girl, low quality lowres Black hands, low quality lowres The background is incoherent, low quality lowres abnormal eye proportion, low quality lowres Abnormal hands, low quality lowres abnormal legs, low quality lowres abnormal feet abnormal fingers, low quality lowres sharp face, low quality lowres tranny, low quality lowres mutated hands, low quality lowres extra limbs, low quality lowres too many fingers, low quality lowres unclear eyes, low quality lowres bad, low quality lowres mutated hand and finger, low quality lowres malformed mutated, low quality lowres broken limb, low quality lowres incorrect limb, low quality lowres fusion finger, low quality lowres lose finger, low quality lowres multiple finger, low quality lowres multiple digit, low quality lowres fusion hand, low quality lowres lose leg, low quality lowres fused leg, low quality lowres multiple leg, low quality lowres bad cameltoe, low quality lowres colorful cameltoe, low quality lowres low polygon 3D game, (over three finger(fingers excluding thumb):2), (fused anatomy), (bad anatomy(body)), (bad anatomy(hand)), (bad anatomy(finger)), (over four fingers(finger):2), (bad anatomy(arms)), (over two arms(body)), (bad anatomy(leg)), (over two legs(body)), (interrupted(body, arm, leg, finger, toe)), (bad anatomy(arm)), (bad detail(finger):1.2), (bad anatomy(fingers):1.2), (multiple(fingers):1.2), (bad anatomy(finger):1.2), (bad anatomy(fingers):1.2), (fused(fingers):1.2), (over four fingers(finger):2), (multiple(hands)), (multiple(arms)), (multiple(legs)), (over three toes(toes excluding big toe):2), (bad anatomy(foot)), (bad anatomy(toe)), (over four toes(toe):2), (bad detail(toe):1.2), (bad anatomy(toes):1.2), (multiple(toes):1.2), (bad anatomy(toe):1.2), (bad anatomy(toes):1.2), (fused(toes):1.2), (over four toes(toe):2), (multiple(feet))

Steps: 20, Sampler: DDIM, CFG scale: 5, Seed: 2276406054, Size: 512x768, Model hash: 925997e9, Clip skip: 2, AddNet Enabled: True, AddNet Module 1: LoRA, AddNet Model 1: Tokiame style v1 (lr 1e-4)(209f83a1), AddNet Weight 1: 1

>Dreambooth – выбор 24 Гб VRAM-бояр

>How much vram do you need for dreambooth

>>I think minimum is 10GB right now, but there might be repos down to 8GB already.

>might be

oh well...

>дримбут

Для него 8гб не хватит.

Ну тогда ему остается лишь терпетьлибо надеяться на рабочий колаб.

>Лора не работает сейчас

гиперсети и эмбединги?

Ебашу 3200 шагов(16 эпох 4 повторений) на Касен, чую что выйдет кал.

https://www.reddit.com/r/StableDiffusion/comments/xzbc2h/guide_for_dreambooth_with_8gb_vram_under_windows/ да не, чет валяется как обычно, наукоботы вместо того чтобы делать что-то стабильно работающее и везде бегут за мечтой на костылях

Устаревший кал

В чем я не прав? Ни у кого в треде не работает, плевать какая скорость

Бтв не вижу лоры на масюню в списке лор. А надо.

Антош, ты если хочешь сказать чего, то ты не стесняйся, говори.

Говорю: дальше будет хуже

Когда починят лору?

А ведь ещё совсем недавно будка прекрасно работала без шума и пыли и обучала локально на 12 гигах, ровно до того момента, как автоматик начал натягивать туда лору.

Когда когда?

А в чем проблема? Нейронка в открытом доступе, делай форк, отключай ненужное, бэкпорть нужное, обучай на датасете с гелбуры. Много шума непонятно из-за чего.

У нас буря в стакане. У кого проблемы - наступает на свой аутизм и откатывается на предыдущий коммит.

Говори, какой коммит рабочий.

Тут лору-то починить не могут, а ты про перепердоливание всей сетки

Покажи хоть одну рабочую лору на 0.4.0.

>А в чем проблема

На самом-то деле проблема скорее всего в новой версии КЛИПа. На форчонге ее понятно превратили в политическую, но клип обучен только на лайоне, и модели на нем похоже очень плохо дообучаются. По крайней мере, по отзывам мастодонтов. Иначе туда бы уже насовали этого нсвфа по самые помидоры. Ждем финальной WD1.4, там понятнее будет.

bedea62ff0ba3d3bf4bc9bb04c04ecbde880bc43

>ждем

Девиз раздела, после каждого обновления все ломается.

>Ждем финальной WD1.4

В чем смысл этого ожидания? Они же не меняют архитектуру, только датасет. Или я ошибаюсь?

Ну так не обновляйся

У них самый масштабный проект дообучения второй версии. Они могут поделиться, есть ли смысл вообще долбиться, или проще просто забить.

ненадо. смотри так.

>18 декабря

Тестил? В любом случае я чекинг устрою завтра.

А, ну насчет предсказаний я не эксперт, на кофейной гуще не гадаю. Я могу лишь то, что уже произошло, проанализировать.

Когда релизнулись первые публичные веса, это жмыхнуло довольно громко. В частности, очень громко вопили художники (отдельные крики слышно до сих пор) и моралфаги, потому что внезапно оно может генерить, хотя и хуевое, но NSFW, а также не очень одетых детей. Чтобы не как-то заглушить крики вокруг своей модели, чуваки которые это пилили попытались прикрыть жопу, убрав из датасета вопящих громче всего художников и добавив фильтр на NSFW.

Я бы сказал, главной ошибкой было то, что релиз первых весов был внезапным и резко поменял статус кво, поэтому появилась куча чуваков, которые обосрались и начали тянуть одеяло обратно.

Параллельно этому, другими чуваками тренились Waifu Diffusion и NAI. Несмотря на то, что эти модели куда более NSFW, всем в целом на них похуй, потому что они так не жмыхали, а наоборот оказались в тени той дискотеки, которая происходила с официальными весами.

Тут мы подходим к вопросу о том, насколько вообще важны релизы официальных весов. ИТТ все используют аниме-модели. Да и тренировать модель может не только лишь одна-единственная компания. Для этого нужны определенные ресурсы, конечно, но тут ситуация далеко не такая, как с DALL-E.

Я так и делаю, сижу на автоматике от 31 декабря, слыхал в новых версиях сломали хайрезфикссделали превью, которое замедляет скорость.

Сколько всего эпох будет?

Единственная рабочая аниме модель - nai от ЧАСТНОЙ компании, на наи все миксы современные основаны. Энтузиасты же сосут хрен с вайфукалом

> слыхал в новых версиях сломали хайрезфикс

Пиздят, вот пруф

Проблемы по началу были, но только у тех, кто пытался генерить по старым промптам, у которых соотношение сторон изображения first pass и highres fix не совпадало. Потом это пофиксили.

> сделали превью, которое замедляет скорость.

На пару секунд максимум, к тому его же можно отключить

>убрав из датасета вопящих громче всего художников

Никаких художников они, по факту, не убирали. Они сменили клип и перетренировали его с нуля на лайоне. В Лайоне то ли 28, то ли 16 работ Рутковского. Вот он и исчез. Предыдущий клип был натренирован на закрытом датасете, и там, походу, было овердохуя Рутковского, вот он и был. Феномен Рутковского - натурально аналог текстового эмбеддинга в масштабах всей модели.

Я не защищаю 2.0, если что. Это редкостное говнище. Просто оно не только художников не может промптить, оно не промптит вообще ничего, даже если любые персоналии убрать.

Думаю, давно пора брать подписочку у новелов, цензуры у их текстовой модели нет. Слишком много добра они сделали. Только оплатить не дают.

>На пару секунд максимум, к тому его же можно отключить

На 1 минуту из 4 на 4090, замерял лично.

другой анон

> самый масштабный проект дообучения второй версии

А не у Unstable Diffusion ли? Ничего не путаешь?

надо.

В треде работает лахта кохьи-автоматика, превью у них ничего не замедляет, 0.4.0 тренирует отлично, а новый хайрезфикс не поломал обратную совместимость. Тьфу блядь, шлюхи продажные.

Качество модели — это вопрос ресурсов и организованности. Вот, например, чуваки пилят распределенную треню: https://github.com/chavinlo/distributed-diffusion/. Вместо того, чтобы кричать, как все плохо, ты мог бы присоединиться к проекту, как-то им помочь.

Интересно получилось. То есть, по факту оно тренилось не на Рутковском, а на том, что его напоминает?

Я в /to/ постил свой член с ручкой в уретре. Могу повторить подвиг, более ни на что не способен.

Сука, кто-то специально заслал в тред агентов, чтобы мучить анонов.

Вопрос в том, почему это говно в релизе вообще оказалось по дефолту включено, когда нищуки свои 20 картинок генерят по полчаса.

>А не у Unstable Diffusion ли? Ничего не путаешь?

Могу, конечно, и путать. Но про Unstable у меня сложилось впечатление, что это развод лохов на деньги, они могут вообще ничего не тренировать и свалить с баблом на теплый остров на неделю, и я выкинул его из инфополя. Вдшники по крайней мере не только обещают, но и делают. Хотя и местами смешно получается.

Интересно было бы узнать, как наи составляли датасет и вообще тренировали свои модели, и почему они это делать не продолжают. В вд походу просто всё нахуй с бур тянут, без разбора, ну и как видно, такой подход не очень подходит.

Да нет, это просто ты рукожоп-неосилятор

Произошёл автоматик

Это я чтоль мерджу коммиты, провалившие тесты, и выпиливаю сами тесты, когда они мешают?

>рукожоп

Покажи как правильно тренировать на 0.4.0, умник бля.

Вот, помоги анону добиться результатов, которые были раньше:

https://github.com/kohya-ss/sd-scripts/issues/98

О "лучше" пока речи даже не идет.

Автолахта отработала, +15 генераций вне очереди

>sd_upscale

Как и любой гений - безумен и не может ясно выражать свои мысли

Ты вникал в суть этих тестов и почему они фейлились?

Что ты несешь вообще? Очереди у него какие-то, охуеть.

>Отдельным выводом из этого следует, что можно радикально ускорить апскейл, уменьшив число кусочков, на которое будет дробиться картинка. Т.е. добавив размер полей (в сд_апскейле по-умолчанию стоит 64 пиксела), мы сможем уменьшить число генераций с 9 (при размерах 1536х1152) до 4 (при размерах 1600х1216) и, соответственно, уменьшить в два раза необходимое время.

Не пойму, 64 к width и height добавить?

Нет, мне хватает того, что я до сих пор пикчу через раз не могу в img2img закинуть, получая плашку error вместо интерфейса инпеинта. Самая боль? Убиваешь плашку в меню разработчика - картинка и интерфейс на месте.

Сломать. Руки. Обе. Сложными переломами.

Чел, ты просто рукожоп. НА последнем коммите автоматика и все работает..

У автоматика код — то еще говно. Я в последнее время на https://github.com/huggingface/diffusers сижу, но там GUI нет, только скрипты. Зато куда стабильнее работает, и со временем не разваливается, а только лучше ставновится.

Эта проблема была при переезде на gradio версии 3.16.2, и её в тот же день пофиксили.

Чутка не понял по поводу лоры

На выходе после тренинга у меня получается модель весом в 2 гига в то время как у анончиков лоры весят по 200-300мб и они их используют как гиперсеть

Как сделать так же

На выходе после тренинга у меня получается модель весом в 2 гига в то время как у анончиков лоры весят по 200-300мб и они их используют как гиперсеть

Как сделать так же

network_dim сколько?

Вопрос на миллион, где находится, во время генерации, ВАЕ и модель?

Ну т.е. оперативка или видюха.

В VRAM

Вкусная лорка на Зеро из Drakengard 3:

https://mega.nz/folder/NmxECaiK#FJbhQ9bBKfTgZBPzycGbIQ

https://mega.nz/folder/NmxECaiK#FJbhQ9bBKfTgZBPzycGbIQ

в компьютере

Тоже попробовал их, когда тренировал лоры на репошке Клона Симо. Тоже понравилось. Но части фич автоматика не хватает, они вроде как и прикручиваются в диффузерах, но пердолиться бывает лень.

Отлично, есть ли способ запиздячить её в общую память графического процессора, чтоб было больше простора для апскейла или я тупой гуманитарий, который не шарит и это так не работает?

На 0.4.0 хоть тренилась?

в голос. весь гайд так-же написан. но ничего, скоро научится

Это что...

VRAM это и есть память графического процессора.

Если ты имеешь ввиду засунуть модель в RAM — то это так не работает.

Можешь, конечно, генерить на CPU, но скорость будет в пару сотен раз медленнее.

Последний коммит кохии (сегодняшний), который вызвал у части из нас противоречивые чувства

Версия релиза мокрописи sd-scripts, у тебя не она, т.к. от 20 декабря у тебя какой то коммит

Ну то есть вчерашний, конечно

У него не это нерабочее говно, в соседнем треде выяснили

Красава. Можешь запиндюрить в репо https://rentry.org/2chAI_LoRA пасскод 2ch

Мне лень, я изучаю питон

я к тому, что меня дико накаляет, что в генерации Общая память графического процессора никак не участвует. Вот я про неё, а не сам VRAM.

> Ошибка: В сообщении присутствует слово из спам листа.

Я в основном для Dreambooth использую, в целом хватает. Немного подправил у себя скрипт, чтобы он читал промпты из txt-файлов рядом с картинками, и просто периодически подтягиваю изменения с репозитория.

Кстати, они сегодня походу еще уменьшили потребление VRAM для Dreambooth, но я еще не пробовал последнюю версию.

Извиняюсь за беспокойство и благодарю за наводку

Нашел колаб в котором есть настройка network dim

Скинь ссылку

Это другое лол

Общая память графического процессора — это надмогз с shared video memory. По сути это виртуальная видео память, а если точнее объем памяти, который может теоретически выделится из ОЗУ на нужды графического процессора (встроенного или дискретного, винде похуй). Но в любом случае CUDA не может использовать эту память.

Самый нормальный этот

Все остальное хуита

Все остальное хуита

Пичальбидаотчаянье, у меня нет лишних 150к на йоба видюху.

Тренить можно на 3060, с оптимизациями оно влезает в 12гб.

КОМПЬЮТЕР ПРОБОВАЛИ ПЕРЕЗАГРУЖАТЬ???? НУ ТОГДА НЕ ЗНАЮ, У НАС ВСЕ РАБОТАЕТ!

У меня 2060

Я о том, что 3060 стоит куда дешевле, чем упомянутая тобой йоба видюха за 150к.

У меня 1060

В твоем можно попробовать просто передать туда --network_dim=128 в форме Additional parameters

У меня 960

Вы по убывающей идете что ли? Мне теперь интересно, насколько далеко вы можете зайти.

У меня старый планшет сяомяо, ему лет 7 уже. Шах и мат.

Вкатываюсь в гей шлюхи, чтобы купить 3060, сеймы в треде есть?

Ну тренируй в колабе тогда, разрешаю.

Ниже только колаб, хотя с lowvram можно и на 650 запустить

У меня не запускается LDSR апскейлер, пишет такую простыню:

Traceback (most recent call last):

File "C:\Program Files\Python310\lib\urllib\request.py", line 1348, in do_open

h.request(req.get_method(), req.selector, req.data, headers,

File "C:\Program Files\Python310\lib\http\client.py", line 1282, in request

self._send_request(method, url, body, headers, encode_chunked)

File "C:\Program Files\Python310\lib\http\client.py", line 1328, in _send_request

self.endheaders(body, encode_chunked=encode_chunked)

File "C:\Program Files\Python310\lib\http\client.py", line 1277, in endheaders

self._send_output(message_body, encode_chunked=encode_chunked)

File "C:\Program Files\Python310\lib\http\client.py", line 1037, in _send_output

self.send(msg)

File "C:\Program Files\Python310\lib\http\client.py", line 975, in send

self.connect()

File "C:\Program Files\Python310\lib\http\client.py", line 1454, in connect

self.sock = self._context.wrap_socket(self.sock,

File "C:\Program Files\Python310\lib\ssl.py", line 513, in wrap_socket

return self.sslsocket_class._create(

File "C:\Program Files\Python310\lib\ssl.py", line 1071, in _create

self.do_handshake()

File "C:\Program Files\Python310\lib\ssl.py", line 1342, in do_handshake

self._sslobj.do_handshake()

ssl.SSLCertVerificationError: [SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed: self signed certificate in certificate chain (_ssl.c:997)

During handling of the above exception, another exception occurred:

Traceback (most recent call last):

File "D:\Neural network\stable-diffusion-webui\modules\call_queue.py", line 56, in f

res = list(func(args, kwargs))

File "D:\Neural network\stable-diffusion-webui\modules\call_queue.py", line 37, in f

res = func(args, kwargs)

File "D:\Neural network\stable-diffusion-webui\modules\txt2img.py", line 52, in txt2img

processed = process_images(p)

File "D:\Neural network\stable-diffusion-webui\modules\processing.py", line 476, in process_images

res = process_images_inner(p)

File "D:\Neural network\stable-diffusion-webui\modules\processing.py", line 614, in process_images_inner

samples_ddim = p.sample(conditioning=c, unconditional_conditioning=uc, seeds=seeds, subseeds=subseeds, subseed_strength=p.subseed_strength, prompts=prompts)

File "D:\Neural network\stable-diffusion-webui\modules\processing.py", line 853, in sample

image = images.resize_image(0, image, target_width, target_height, upscaler_name=self.hr_upscaler)

File "D:\Neural network\stable-diffusion-webui\modules\images.py", line 269, in resize_image

res = resize(im, width, height)

File "D:\Neural network\stable-diffusion-webui\modules\images.py", line 261, in resize

im = upscaler.scaler.upscale(im, scale, upscaler.data_path)

File "D:\Neural network\stable-diffusion-webui\modules\upscaler.py", line 64, in upscale

img = self.do_upscale(img, selected_model)

File "D:\Neural network\stable-diffusion-webui\extensions-builtin\LDSR\scripts\ldsr_model.py", line 54, in do_upscale

ldsr = self.load_model(path)

File "D:\Neural network\stable-diffusion-webui\extensions-builtin\LDSR\scripts\ldsr_model.py", line 40, in load_model

model = load_file_from_url(url=self.model_url, model_dir=self.model_path,

File "D:\Neural network\stable-diffusion-webui\venv\lib\site-packages\basicsr\utils\download_util.py", line 98, in load_file_from_url

download_url_to_file(url, cached_file, hash_prefix=None, progress=progress)

File "D:\Neural network\stable-diffusion-webui\venv\lib\site-packages\torch\hub.py", line 593, in download_url_to_file

u = urlopen(req)

File "C:\Program Files\Python310\lib\urllib\request.py", line 216, in urlopen

return opener.open(url, data, timeout)

File "C:\Program Files\Python310\lib\urllib\request.py", line 519, in open

response = self._open(req, data)

File "C:\Program Files\Python310\lib\urllib\request.py", line 536, in _open

result = self._call_chain(self.handle_open, protocol, protocol +

File "C:\Program Files\Python310\lib\urllib\request.py", line 496, in _call_chain

result = func(*args)

File "C:\Program Files\Python310\lib\urllib\request.py", line 1391, in https_open

return self.do_open(http.client.HTTPSConnection, req,

File "C:\Program Files\Python310\lib\urllib\request.py", line 1351, in do_open

raise URLError(err)

urllib.error.URLError: <urlopen error [SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed: self signed certificate in certificate chain (_ssl.c:997)>

Что ему надо, я тупой.

Traceback (most recent call last):

File "C:\Program Files\Python310\lib\urllib\request.py", line 1348, in do_open

h.request(req.get_method(), req.selector, req.data, headers,

File "C:\Program Files\Python310\lib\http\client.py", line 1282, in request

self._send_request(method, url, body, headers, encode_chunked)

File "C:\Program Files\Python310\lib\http\client.py", line 1328, in _send_request

self.endheaders(body, encode_chunked=encode_chunked)

File "C:\Program Files\Python310\lib\http\client.py", line 1277, in endheaders

self._send_output(message_body, encode_chunked=encode_chunked)

File "C:\Program Files\Python310\lib\http\client.py", line 1037, in _send_output

self.send(msg)

File "C:\Program Files\Python310\lib\http\client.py", line 975, in send

self.connect()

File "C:\Program Files\Python310\lib\http\client.py", line 1454, in connect

self.sock = self._context.wrap_socket(self.sock,

File "C:\Program Files\Python310\lib\ssl.py", line 513, in wrap_socket

return self.sslsocket_class._create(

File "C:\Program Files\Python310\lib\ssl.py", line 1071, in _create

self.do_handshake()

File "C:\Program Files\Python310\lib\ssl.py", line 1342, in do_handshake

self._sslobj.do_handshake()

ssl.SSLCertVerificationError: [SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed: self signed certificate in certificate chain (_ssl.c:997)

During handling of the above exception, another exception occurred:

Traceback (most recent call last):

File "D:\Neural network\stable-diffusion-webui\modules\call_queue.py", line 56, in f

res = list(func(args, kwargs))

File "D:\Neural network\stable-diffusion-webui\modules\call_queue.py", line 37, in f

res = func(args, kwargs)

File "D:\Neural network\stable-diffusion-webui\modules\txt2img.py", line 52, in txt2img

processed = process_images(p)

File "D:\Neural network\stable-diffusion-webui\modules\processing.py", line 476, in process_images

res = process_images_inner(p)

File "D:\Neural network\stable-diffusion-webui\modules\processing.py", line 614, in process_images_inner

samples_ddim = p.sample(conditioning=c, unconditional_conditioning=uc, seeds=seeds, subseeds=subseeds, subseed_strength=p.subseed_strength, prompts=prompts)

File "D:\Neural network\stable-diffusion-webui\modules\processing.py", line 853, in sample

image = images.resize_image(0, image, target_width, target_height, upscaler_name=self.hr_upscaler)

File "D:\Neural network\stable-diffusion-webui\modules\images.py", line 269, in resize_image

res = resize(im, width, height)

File "D:\Neural network\stable-diffusion-webui\modules\images.py", line 261, in resize

im = upscaler.scaler.upscale(im, scale, upscaler.data_path)

File "D:\Neural network\stable-diffusion-webui\modules\upscaler.py", line 64, in upscale

img = self.do_upscale(img, selected_model)

File "D:\Neural network\stable-diffusion-webui\extensions-builtin\LDSR\scripts\ldsr_model.py", line 54, in do_upscale

ldsr = self.load_model(path)

File "D:\Neural network\stable-diffusion-webui\extensions-builtin\LDSR\scripts\ldsr_model.py", line 40, in load_model

model = load_file_from_url(url=self.model_url, model_dir=self.model_path,

File "D:\Neural network\stable-diffusion-webui\venv\lib\site-packages\basicsr\utils\download_util.py", line 98, in load_file_from_url

download_url_to_file(url, cached_file, hash_prefix=None, progress=progress)

File "D:\Neural network\stable-diffusion-webui\venv\lib\site-packages\torch\hub.py", line 593, in download_url_to_file

u = urlopen(req)

File "C:\Program Files\Python310\lib\urllib\request.py", line 216, in urlopen

return opener.open(url, data, timeout)

File "C:\Program Files\Python310\lib\urllib\request.py", line 519, in open

response = self._open(req, data)

File "C:\Program Files\Python310\lib\urllib\request.py", line 536, in _open

result = self._call_chain(self.handle_open, protocol, protocol +

File "C:\Program Files\Python310\lib\urllib\request.py", line 496, in _call_chain

result = func(*args)

File "C:\Program Files\Python310\lib\urllib\request.py", line 1391, in https_open

return self.do_open(http.client.HTTPSConnection, req,

File "C:\Program Files\Python310\lib\urllib\request.py", line 1351, in do_open

raise URLError(err)

urllib.error.URLError: <urlopen error [SSL: CERTIFICATE_VERIFY_FAILED] certificate verify failed: self signed certificate in certificate chain (_ssl.c:997)>

Что ему надо, я тупой.

Не может скачать модель LDSR из-за РКН

Да, технически, можно запустить и на проце, если ты не боишься подождать.

Я на пейперспесе, там тоже говно мамонта с 8гб. Но мне норм, запускаю - и пусть себе печется. Колаб нужно мониторить, много эпох там не натренишь.

660

У меня 660

У меня 3080, но я периодически запускаю тренировку в колабе, чтобы не кипятить карточку и иметь возможность сразу смотреть оттрениные эпохи

Лолшто, у меня прокси стоит по умолчанию в винде, какой РКН.

Скачай руками и закинь куда просит. Там два файла надо будет дотащить.

Cлабаки, гигавладелец 9400

Понял-принял, ссылка благо есть в батнике. И чтоб не спамить, где ещё можно апскейлы поскачивать, чисто для интереса, а то чет тут нет отдельного раздела по ним.

М, я думал про паперспейс, но так и не смог понять, какие у них бесплатно доступны видеокарты. И вроде они требуют кредитку для регистрации? Как с этим решил вопрос?

Благодарю

У них ахахах Квадро М4000, мне кажется, им их бесплатно со склада отдали, чтобы не утилизировать. Они не пашут вообще, но для неспешного выпекания лор - норм.

И нет, кредитка для бесплатного тира не нужна, нужен только сотовый.

Анон, если це твоя лора, а можешь датасет еще скинуть пожалуйста?

Но он литералли по этой ссылке.

А сколько повторений концепта лучше?

Сколько вы ставите, аноны?

Сколько вы ставите, аноны?

А, точно. Иннос ослепил меня.

Пойду выпилюсь нахуй

Круто.

А сделайте эту плиз

https://drive.google.com/file/d/1374wdeS1t9gEJe-g59gNsH6cl6zRm3O9/view?usp=sharing

Это Имари. Только к ней нужны еще теги, позже займусь и залью с тегами, ну или сами сгенерируете. Если мало пикч, могу еще нащелкать скринов из адаптации.

Не та ссылка, но тоже сгодится

Почему никто не постит свои лоры, хотя все их так старательно обучают? В этом треде ни одной ссылки ни на одну лору нет.

У нас лавочка накрылась

пасаны хай fx 5500 amd sempron 2600+ есть шансы

Так есть же ссылки.

Я, например, обучаю не слишком анимешные лоры, которые нахуй никому не нужны и не интересны, судя по списку уже загруженного и вообще в целом по активности на доске. Тут тусовка любителей китайских мультиков, вон они пусть и шарят.

Сейм

двачую. лупоглазые всех отовсюду повыгоняли, путь теперь всё сами делают.

А мы-то тут при чем? Лупоглазые в соседнем треде.

Семёныч, успокойся.

Покажи, я не нашел. В прошлом треде 5 как минимум, в этом ни одной.

Кринж

>которые нахуй никому не нужны и не интересны

Тыскозал?

>А мы-то тут при чем? Лупоглазые в соседнем треде.

Да, сидеть сразу во всех тредах невозможно.

где пруф что не лупоглазый?

А как этим пользоваться? Да, я тупой.

Сразу видно: человек за кобольдом не сидел.

У тебя не получится нихуя, понимаешь? Надо заниматься лет двадцать, ёпта

>Я, например, обучаю не слишком анимешные лоры

И я. Я вообще на Хассане.

Хз, обучал лору с теликами, все норм;)