вкоть

Генерировайте.

там наконецто натвис 2.7 вышел, в комментах говорят ЯБЕТ

Анончики, там в /b/ снова SD тред появился, го возрождать былое

Нужен будет перекат сд шапкой

https://2ch.hk/b/res/313181764.html

Нужен будет перекат сд шапкой

https://2ch.hk/b/res/313181764.html

Там написано, что это ЧМАЛЛИ тред.

иди на хуй, говнодел-битард, итт приличные люди сидят

Blyat tred govna kakoito

Ты зайди туда, там от индусософта ничего не осталось. Это наш тред.

Я в курсе, что это уже давно натвис+дмд тред про 1woman standing, но можно же развеяться. На самом деле, в /b/ и от woman standing некоторые охуеют. А если еще и лоры заюзать, то расшевелим это место.

в /b/ тред не будет жить, надо это признать.

Сейчас вкатываться в SD стало сложнее, обычные битарды не будут морочиться с установкой комфи и ограничатся онлайн проприетарщиной, которую им пока что дают жрать кабанчики с барского плеча.

>охуеют

щас бы школоту развлекать

Да кто такой этот ваш yello блять, ну гуглится

аноны, кто-то генерил на этой модели? выглядит круто, но результаты слишком мыльные, скилл ишью, но чет особо не вижу инфы в инете по ней, будто все родились уже со знаниями о модели

есть usage tips?

https://civitai.com/models/325263/playground-ais-playground-v25-1024px

есть usage tips?

https://civitai.com/models/325263/playground-ais-playground-v25-1024px

Это вперд так работает, потому что на вперде лак оф дитейлс это фича, зато суперконсист и следование промту. Попробуй всякие консистенси траектори лоры, дмд и моды дмд с прошлого треда подходят.

вроде более менее разобрался сейчас, вообще крутая штука, красивая, попробую, конечно, дмд покрутить

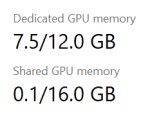

Мне не нравится что у меня винда жрет 1.1 гига врам

Это же дохуища

Неужели всем норм просто отдавать такую мощь которая могла бы пойти на генерацию?

Это же дохуища

Неужели всем норм просто отдавать такую мощь которая могла бы пойти на генерацию?

Ну отключи отрисовку на карте

Как сделать рандомный сид по настоящему рандомным?

Вот я не указал место, внешность, запустил 10 генераций и мне и мелкими отличиями насрало почти тоже самое.

И если указать место типа парк то там будет именно один и тот же парк.

Как этот "рандом" работает?

Вот я не указал место, внешность, запустил 10 генераций и мне и мелкими отличиями насрало почти тоже самое.

И если указать место типа парк то там будет именно один и тот же парк.

Как этот "рандом" работает?

Через wildcard делай. Вписывай туда 10+ или скок надо вариантов и будет случайный из них выбирать.

Просто так тебя сильно случайного не на выдаёт, так как там другие слова подтягивают всё что ты не указал.

Никак потому что рандом влияет на исходный шум из которого будет восстанавливать картинку, а не на детали которыми будет восстанавливать. Чтобы поменять набор деталей тебе нужно указать конкретный парк или его особенности и надеяться что они повлияют на CLIP, тогда набор деталей будет чуть другим. Ну или тренить лору на фотки конкретного парка.

Может кому-то пригодится. Сделал страницу для сравнения лор/чекпоинтов.

Сначала генерите X промптов на первой лоре/чекпоинте, столько же на следующей и так далее. Затем переименовываете это всё в Проводнике в image, индексы Проводник добавит сам. Кидаете эти генерации в папку 'images', кидаете рядом этот html и запускаете. Выставьте правильное количество промптов (Sets), количество моделей должно угадать само. Жмёте Размешать, результаты в статистике должны примерно усредниться.

На экране должно быть видно несколько пикч с разных моделей в случайном порядке, но с одним промптом. И начинаете тягать пикчи, выставляя по собственному предпочтению, слева-направо, сниз-вверх, сначала та, что лучше всего получилась. Колесико мыши или стрелки листают страницы. Как закончите, слева будет наглядно видно, какая модель вам действительно понравилась больше. Может помочь с решением какую эпоху натрененной лоры оставить, какая из сотни лор эммы уотсон лучшая или выбрать любимую версию натвиза под дмд.

HTML: https://pastebin.com/raw/ugHDggbv

Гайд от клода, если я написал неясно: https://rentry.co/ozfe3p49

Сначала генерите X промптов на первой лоре/чекпоинте, столько же на следующей и так далее. Затем переименовываете это всё в Проводнике в image, индексы Проводник добавит сам. Кидаете эти генерации в папку 'images', кидаете рядом этот html и запускаете. Выставьте правильное количество промптов (Sets), количество моделей должно угадать само. Жмёте Размешать, результаты в статистике должны примерно усредниться.

На экране должно быть видно несколько пикч с разных моделей в случайном порядке, но с одним промптом. И начинаете тягать пикчи, выставляя по собственному предпочтению, слева-направо, сниз-вверх, сначала та, что лучше всего получилась. Колесико мыши или стрелки листают страницы. Как закончите, слева будет наглядно видно, какая модель вам действительно понравилась больше. Может помочь с решением какую эпоху натрененной лоры оставить, какая из сотни лор эммы уотсон лучшая или выбрать любимую версию натвиза под дмд.

HTML: https://pastebin.com/raw/ugHDggbv

Гайд от клода, если я написал неясно: https://rentry.co/ozfe3p49

>новый мод на высокий CFG в DMD2 от местноанона

>В общем вот несколько моделек

На цивит запостишь? Там какого-то хуя исчезла оригинальная DMD2. И LCM в цивитовском генераторе нету.

Ну я писал что то типа случайная туристическая достопримечательность, уже не помню. Получилась вангерл путешественница.

дмд не подходит или я не разобрался как использовать

8 шагов на лсм карасс делают изображение будто никакой лоры нет и мне буквально 8 шагов рисует

но и на 50 шагах ситуация та же

в общем, тяжело, не понимаю

Как вообще может лора работать на совсем другой базовой модели, плейграунд ведь не сдхл. Тот анон пошутил или не понял.

Ебанулся чтоли? Плейграунд это сдхл с впиздяченным континус vpred edm.

кфг1 поставь, перепроверь что поставил лцм а не лмс.

А вообще лучше скрин параметров кидай, может ты там вае таесд подключил или еще какую глупость.

Ты поклоунствовать решил? Архитектура SDXL, но свой трен с нуля и даже подход к данным другой, все есть в тех. доке. Не говоря уже про то, что буквально написано базовая модель.

Тогда и нубай базовая модель.

Нуб это взяли готовые веса базовой SDXL и их файнтюнили. Для плейграунда веса SDXL никак не использовались.

>Для плейграунда веса SDXL никак не использовались.

Архитектура сдхл построена на датасетах LAION, COCO, OpenImages, физически собрать такой гигантский объем данных и натренировать их без мощностей стабилити микрочеликами с плейграунда невозможно, поэтому твой тезис фактически неверен, веса сдхл внутри плейграунда на месте. Касательно CT лор - они работают не с файнтюненными весами, а с данными архитектуры, поэтому то что дмд может не работать с пг это крайне маловероятно, щас зачекаю.

Одобряю. Так-то юзал его долго. Очень годная модель. Ограничения - квадрат, не нсфв. Зато в кровищу шикарно может. Я как-то вбрасывал итт в начале года ртутную бабу с дефолтным воркфлоу без лора и т.п. и на тот момент было прям неплохо.

>щас зачекаю

Да, CT лоры не работают, но ошибок несовпадения весов нет. То есть это EDM подсирает и нужен какой-то доп костыль трансфера лор под EDM.

Аноны, добыре люди, объясните, как всё это собирается? Вот у LLM относительно всё просто. Есть модель, и есть фронтенд, который по сути работает с моделью и уже в этом фронтенде и размер контекста настраивается, и прочие параметры хранятся. В случае с рисовальными генеративными сетями такая же ситуация? Или это как то иначе реализовано.?

Вот есть фронтенд Комфи ,как я понял. Посоветуйте тогда модель, саму нейронку, для генерации реалистичных дам. В первую очередь интересуют некоторые звезды ТВ

Вот есть фронтенд Комфи ,как я понял. Посоветуйте тогда модель, саму нейронку, для генерации реалистичных дам. В первую очередь интересуют некоторые звезды ТВ

Если по аналогии с ллм, то это почти так же, но представь что ты когда ставишь: температуру, семплинги, пенальти и т.п. в настройках ллм, сохраняешь конфиг и забываешь для конкретной ллм, то тут ты будешь пердолить каждый раз настройки в фронтэнде почти реалтайм не только с разными моделями, но и с одной и той же по несколько раз за сеанс. И здесь не модели разные, а чекпоинты. Модели это база. Но да, может проще говорить - модели.

Ну попробуй джагернаут, там всёвключено и вероятность что там будут селебрити почти 90%. Не юзай никакие мержи - это кал васянов. Мерж любой школьник на коленке в комфи может сделать за наносек.

>В случае с рисовальными генеративными сетями такая же ситуация?

Нуу да. Только фронтенд это интерфейс просто, а бекенд питоноскрипты и работа с диффузерами, второго ты просто не касаешься.

>Посоветуйте тогда модель, саму нейронку, для генерации реалистичных дам. В первую очередь интересуют некоторые звезды ТВ

Если тебе нужны конкретные ебальники, то нужно или найти натрененную лору (или натренить самому) на этот ебальник и ее уже подключать в основную модель, вероятность что концепт какой-нибудь Аси Говновой будет содержаться в модели примерно нулевой, сама базовая модель содержит основные понятия наверно только о звездах уровня бредпиттов, у файнтюнов в принципе то же самое, вот допустим я взял кальцион.

Можно поступить более проще - всять фейсид/инстантид/ипадаптер и скормить им ебальник, который будет вписываться в ген.

По самим моделям ну смотря что тебе надо. Есть фул нсфв, есть софт, есть ноннсфв, много моделек кароч.

>Архитектура сдхл построена на датасетах

Архитектура это принципы устройства, а датасет это картинки и их описания на которых тренировали.

>натренировать их без мощностей стабилити

Нормальные у них мощности

"After bringing our 256xH100 cluster online in October 2023, we swiftly advanced towards training our first foundation model from scratch, and we released Playground v2 by December of the same year—less than three months later."

Обрати внимание, foundation model, from scratch, хоть это и про 2.0.

> И здесь не модели разные, а чекпоинты. Модели это база. Но да, может проще говорить - модели.

Одна модель, но разные чекпоинты? И все эти чекпоинты разные? Как они работают?

>Если тебе нужны конкретные ебальники, то нужно или найти натрененную лору

Про лору я знаю. Мне бы какую то базу что ли, поверх которой я уже могу лору накатить. Вот, хочу генерить реальных человечков.

> Есть фул нсфв, есть софт, есть ноннсфв, много моделек кароч.

Есть какой нибудь топ? На что смотреть тоже непонятно мне.

>Архитектура это принципы устройства, а датасет это картинки и их описания на которых тренировали.

Так архитектура не заработает без знаний.

>256xH100

Жиденько.

Stability AI, по открытым данным и заявлениям, управляет кластером с более чем 5000 GPU. Большинство этих GPU относятся к категории высокопроизводительных, таких как NVIDIA A100 или H100, которые являются стандартом для задач глубокого обучения.

да не, я все перепробовал

не первый раз ты уже предупреждаешь про лмс

а вае стоит с их хагинфейса

Natvis

>Одна модель

Одна базовая модель, которая является фундаментальной архитектурой, знает много всего, но генерирует посредственно или средне (неприменимо ко всем в прочем, есть сд 3.5 допустим которая хорошо генерит изкаропки, или дистиллят флюкспро в виде флюксдев). Ее задача предоставлять базу для коммьюнити рисерч и файнтюнов.

>но разные чекпоинты? И все эти чекпоинты разные? Как они работают?

Вот смотри у тя есть базовая модель. Ты решаешь файнтюнить модель на датасете условно 1 миллион картинок с кучей новых концептов внутри. Получается новый отличный от базы чекпоинт с другим качеством генераций и другими дополнительными концептами. И так для каждой файнтюненной модели. Да, это разные чекпоинты.

>Мне бы какую то базу что ли, поверх которой я уже могу лору накатить. Вот, хочу генерить реальных человечков.

>Есть какой нибудь топ?

Ну попробуй базу треда для голых пезд https://civitai.com/models/617652?modelVersionId=1030169

> На что смотреть тоже непонятно мне.

Идешь на цивитай, фильтруешь модели по тегу TRAINED и семейству архитектуры, смотришь.

Понял, спасибо. Пошёл исследовать.

а что такое вперд за зверь?

V-pred: модель предсказывает скорость изменения (velocity) изображения. Это улучшает стабильность и снижает необходимость в отрицательных промптах, поскольку ошибка в предсказании скорости менее чувствительна к мелким деталям.

Как правило, способствует более плавной генерации с фокусом на общих формах и композиции. За счет того, что модель предсказывает скорость изменения, изображения получаются стабильными, с меньшим количеством артефактов и "зернистости". Но при этом v-pred может немного потерять в детализации — мелкие текстуры и тонкие линии могут быть сглажены или менее выражены.

Eps-pred: модель предсказывает непосредственно шум (ε) в изображении, который добавляется на каждом шаге. Этот метод популярен в более старых моделях и дает точные результаты, но требует настройки по количеству шагов и конфигурации для снижения шума.

Обеспечивает точное восстановление деталей, так как напрямую предсказывает шум. Этот метод позволяет модели захватывать мелкие текстуры и высокую детализацию, включая тонкие линии и текстуры поверхности. Однако eps-pred может быть менее устойчивым к артефактам и шуму, особенно при работе с большим количеством шагов, что может сделать результат более "зернистым" и чувствительным к настройкам.

В общем, v-pred предпочтителен для более гладких, менее шумных изображений, особенно если важна стабильность на низких шагах, тогда как eps-pred лучше для детализированных, текстурных изображений, но может требовать большего контроля над параметрами генерации.

Пиши в промпте что-то типа: блек хаир, браун хаир, блонде хаир и т.п. будет тебе перебор цветов волос к примеру, с остальным так же.

>флакс

>нейронка ебёт все что движется

>не умеет в прон

доколе?

>нейронка ебёт все что движется

>не умеет в прон

доколе?

И это единственная карточка в пека.

У меня жрёт 400мб. 11 винда про.

а есть пример использования воркфлоу, и какие ноды нужны и где модель скачать?

может я не по адресу. скажите, какой нейронкой можно заменять фоны для вещей и одежды на маркетплейсах? сам нищук, ищу способы заработать на кворке

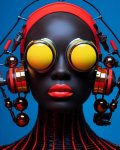

Как добиться такого эффекта освящения кожи?

>А в чём сделал?

Я уже просто не отвечаю на такие вопросы, потому что некоторые рвутся на мелкие части от ответа. Попробую ещё раз: сделал в натвис+дмд2+спо с помощью фокус. Инпеинтил в нем лица и что-то ещё. Заметно что лица, из-за этого стали чётче чем всё остальное и я подумывал чтобы размыть их немного, что бы скрыть инпеинт.

Интересно кто как решает это? Пробовал проходить после со слабым денойзом всё изображение, но не понравилось что теряются мелкие детали.

может есть какой-то способ по набору фото понять примерный промт?

это тебе не /б, чтоб постить сюда нерелейтед видеокал

Дарова аноны, вкатываюсь, накатил гуй от автоматика, дефолтная модель, генерирует сюрреалистический кривой бред, куда нажать чтобы стало хорошо?

ставь фокус и мозги не еби ни себе ни окружающим, всё внутри есть уже, (portable) ничего jnltkmyj ставить не нужно, своя импАинт-модель (так лучьше?). Выбираешь реалистик профиль, стилизацию: гипереалистик, Fooocus negative для борьбя с уродствами, и volumetric light. Всего 3 фильтра и ты охуеешь. + ко всему можешь добавить улучшайзеры типа флюкс styled лоры.

Как в comfyui сохранить сразу все сгенерированные изображения в одной партии?

Спасибо, попробую

>дефолтная модель, генерирует сюрреалистический кривой бред

Что там по дефолту качается в каломатике без наличия моделей в папке моделей напомни? Полторашный чекпоинт? Ну так что полтораха что сдхл базовые не предназначены для простой генерации без нужных навыков и знаний.

Тебе нужна не дефолтная базовая модель, а допустим натвис https://civitai.com/models/617652?modelVersionId=1030169 или какойнибудь понитрейн https://civitai.com/models/317902/t-ponynai3 или https://civitai.com/models/405630/zavyfantasiaxl-pdxl или нубай https://civitai.com/models/833294?modelVersionId=1022833

+ лора для убыстрения генерации и повышения консистенции, по дефолту итт большинство сидит на дмд2 https://huggingface.co/tianweiy/DMD2/blob/main/dmd2_sdxl_4step_lora_fp16.safetensors который работает ток на 1 CFG и LCM семплере, но есть еще вот эти моды с расширенным полем использования на более выскоих цфг и других семплерах https://huggingface.co/YOB-AI/DMD2MOD/tree/main https://huggingface.co/YOB-AI/HUSTLE/tree/main

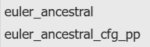

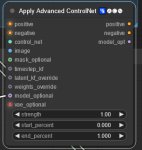

Ноды есть в комплекте с комфи. Воркфлоу базовый плюс вставленная нода с пикчи.

Базово любой впред требует левую ноду, и только плейграунд (и чекпоинты на его основе) едм впред под себя справа.

>а допустим натвис

Слышь, нахуй иди а со своей дэмэдой ебаной, больной псих, сук...

Не слушай этого придурка, он тут всем мозг выебал своим натвисом. Ещё раз: натвис хорош только хуи в жопах обводить на рефайне. Больше ни для чего...

Ставь сначала фокус, а потом хоть запробуйся...

Съебись с треда профессионалов со своим факэсс, шизосоветами и нулевым скиллом, пабрацки.

>где модель скачать

А насчет моделей, их не очень много

очевидный пг 2.5 https://civitai.com/models/325263/playground-ais-playground-v25-1024px под едм

впред нубай https://civitai.com/models/833294?modelVersionId=1070239

еще флаффирок/изифлафф для полторахи впреды

т.е. добавляю в воркфлоу ноду либо слева либо ноду справа?

Да

>нубай

чем он лучше аутизммикса?

Тем что это не понибейз говномердж аутизм, а натрененный на овер 8 лямах картиночек с данбуру и е621 чекпоинт, со всеми описаниями оттуда в том числе и калцептами которые ты можешь встретить на перечисленных сайтах. Считай нубайку убийцей поней по возможностям, динамике и тд и тп.

>нубайку убийцей поней

заебись спасибо

к ней подойдут лоры на базовой sdxl или лучше перетренить?

э, алё, ты тут в меньшинстве как бы, все адекваты юзают дмд

>к ней подойдут лоры на базовой sdxl

Если ты про стили и персонажей, то нет. Пик1 без лоры на мельниотянок https://civitai.com/models/441721/melnitsa-girls-style-three-heroes-tri-bogatyrya-melnica , пик 2 с ней. Видно что какие-то слои применило из лоры, но не больше, т.к. токен концепта я вызвал и он должен был аленушку ебануть.

С лорами не под пони тоже самое, адд дитейл не работает.

Так что максимум лоры убыстрялки (они точно работают) можно юзать и лучше тренить заново.

Сколько нужно врам для flux fp32?

аноны помогите разобраться

Какого такого? Blue light hue on skin попробуй, если как на первой.

ну и кал, пиздец, нахуй хранить такое на своей пека?

Делай видео-гайд. Ничего не понятно

уменялапки анон

>или выбрать любимую версию натвиза под дмд

тут без вариантов 1ая просто потому, что в первой по-дефолту блеклый и мыльный файнтюн, который с дмд становиться будто идеально завершённым, натвис выше версиями менее эстетичо и менее уважительно смотрится в сравнении с 1й

>Что там по дефолту качается в каломатике без наличия моделей в папке моделей напомни? Полторашный чекпоинт?

Да, SD 1.5, pruned emonly что бы это не значило

И кстати, что такое лоры?

скрыл...

>что такое лоры?

Надстройка над моделью указывающая ей как генерировать что бы получилась определенная внешность человека, стиль или объекты.

анончик, что дмд мод пилил, что-то у меня тоже сильно пережаривает, явно что-то не так делаю

хахахахахх, и так у них всё...

Поиграйся с настроечками, выбери другой семплер/шедулер, рестарт к этому моду не подходит

что-то не работает v-prediction, что я делаю не так?

>SANA от Нвидия

Я вам новую модельку принёс. Прорывная!

>что я делаю не так

пытаешься въебать вперд в обычную модель сдхл?

>Но есть градио со ссылками на секретные веса на хаггингфейсе.

Так вот же они

https://huggingface.co/Efficient-Large-Model/Sana_1600M_512px/tree/main

https://huggingface.co/Efficient-Large-Model/Sana_1600M_1024px/tree/main

Анон, да почему у нас картинки отличаются? Не то чтоб меня это парило. У меня уже спортивный интерес. Есть теория?

>поддержки дифузерс нет

(🔥 New) [2024/11] Training & Inference & Metrics code are released.

(🔥 New) [2024/11] Working on diffusers.

ээ блять

>Да, SD 1.5, pruned emonly что бы это не значило

Не надо это использовать. Это совсем сырая база для тюнинга, не для генерации. Скачай человеческий файнтюн, какой-нибудь EpicPhotogasm или хоть банальный Dreamshaper для начального освоения. Ну это если тебе именно 1.5 модели нужны, типа комп не тянет иксельку.

https://civitai.com/models/132632/epicphotogasm

Скажи версию комфи, есть ли установленные эксперимнетал ноды и другие семплеры, покажи командную строку

Алсо есть аргументы запуска комфи какие-либо?

Скрипты не ковырял, если что.

Да, но там ничего такого - пикрел

А вверх ногами, а занюх труханов? Самые важные не сделал бля...

как ты за 8 минут скачал с обниморды?

Обновился только что до 0.3.1 моя картинка не изменилась. Щас ради интереса рядом голый комфи поставлю гляну.

О, значит не такая соевая. Надо будет попробовать без цензуры у себя запустить как только приедет видеокарта.

Во-первых, не все тут сидят с GPRS интернетом. Во-вторых, в исходном посте есть ссылка на онлайн-демо.

А отключи лору и покажи результат, выглядит как просто разный инишл нойз у нас, сид теперь 1 есличе

Попытался поставить поней, но вот что вышло

torch.cuda.OutOfMemoryError: CUDA out of memory. Tried to allocate 26.00 MiB. GPU 0 has a total capacty of 6.00 GiB of which 0 bytes is free. Of the allocated memory 12.28 GiB is allocated by PyTorch, and 435.76 MiB is reserved by PyTorch but unallocated. If reserved but unallocated memory is large try setting max_split_size_mb to avoid fragmentation. See documentation for Memory Management and PYTORCH_CUDA_ALLOC_CONF

Это кiнец?

torch.cuda.OutOfMemoryError: CUDA out of memory. Tried to allocate 26.00 MiB. GPU 0 has a total capacty of 6.00 GiB of which 0 bytes is free. Of the allocated memory 12.28 GiB is allocated by PyTorch, and 435.76 MiB is reserved by PyTorch but unallocated. If reserved but unallocated memory is large try setting max_split_size_mb to avoid fragmentation. See documentation for Memory Management and PYTORCH_CUDA_ALLOC_CONF

Это кiнец?

в автоматик ставил? попробуй фордж или комфи

Для 6 гиговых нищенок есть FP8 укладывающаяся в 4 кека https://huggingface.co/YOB-AI/PDXL-FP8/tree/main

Не забудь подключить вае

Не... Щас поставлю голый комфи рядом гляну, надеюсь это не на моей стороне пайпы погнуло, лол. У тебя там кстати высота странная, я учёл и это если что.

>У тебя там кстати высота странная

бля, мисскликликнул сорян

А сколько вообще нужно гигов для нормальной генерации?

Во, запустил на свежем комфи, релизнутым 50 мин назад. Даже настройки не менял -1й пикрел. Мой обжитой комфи, что я выкладывал скрин с кастомками - 2й пикрел. Анон, ты там чёт у себя перепердолил походу и забыл.

проверь кирилицу-латиницу в промте

>надеюсь это не на моей стороне пайпы погнуло

Я всетаки думаю что у нас просто почему-то с разных устройств берется инишл нойз

Был какой-то пак нод где можно устройство выбирать с которого нойз выдавливается (цпу или гпу)

12, ну на крайний случай 8

Для сдхл 12гигов, если контролнетом и еще чем обмазаться то и этого будет маловато.

Хз сколько у того анона что ты спрашиваешь, но у меня 4060ти8врам, брал когда ещё не было версии с 16, так вот на флюс деве 1 мин 20 шагов, на всех остальных сдхл там настолько быстро, что не замечаю даже. Специально, осознанно под нейронки я бы щас брал версию с 16 конечно.

>V-pred: модель предсказывает скорость

Не могу представить как оно там под капотом выглядит, но у меня всегда один большой вопрос к таким методам, аналогично тому как делают апскейлеры фпс видео по двум соседним кадрам, а про производную, ака ускорение, мы типа забыли? Похуй, да?

В видео, очевидно, кадр хотелось бы считать не только по двум соседним. А здесь что?

Говно ваша ссана. По скорости как XL, но VAE ультрашакальный, качество просто дно. При этом все минусы флюкса на месте и приумножены. Дикий блюр что даже флюкс позавидует, негатив не помогает. Новый уровень цензуры - если в промпте хотя бы одно слово типа ass/tits, генерирует красное сердечко как на 4 пике, такой анальной цензуры вроде даже в SD 3.0 не было. Лица как будто на генерациях флюкса тренили - флюксоподбородки на месте, но при этом жуткий пластик. Вместо дашкама что-то совсем не понятное, как будто картинг, медведя на дороге в принципе отказывается генерить, вообще ни в каком виде.

Будто это неудачный файнтюн шнеля. Судя по волосам ссанина не умеет в тонкие линии, струны и провода, даже трава выше на пике странная сетка. Бля, даже нубаи может струны и провода...

> генерирует красное сердечко как на 4 пике

А нет, напиздел. Это в их демо сэйфти-чек встроен. Но когда убрал начались флешбеки флюкса. Они реально на генерациях флюкса тренили, блять?

Да, может быть, скорей всего ты прав. Вот я для теста взял воркфлоу в этом пнг https://civitai.com/images/22433336 и результат у меня отличается.

Домики наверное даже кривее полторахи. В текст умеет плохо - первое слово пишет, дальше уже всё. Цветные ящики ставит друг на друга как положено, но нахуя при таком оно надо не ясно. Если разрешение выкрутить, то становится получше, но всё равно шакально.

Как модель назовёшь, так она и поплывёт... Надо было китайцам не выпендриваться и назвать как-нибудь куньлуньдадаоди

Он в другом воркфло генерировал с адетейлером и кфг рескейл, на странице чекпоинта написано.

Не, там в самом, конкретно в этом пнг, у него воркфлоу что на пикрел.

Хм.

Оба...

Вот что об этом говорит гпт

Различные версии драйверов и библиотек

Драйверы видеокарт и CUDA могут использовать различные алгоритмы оптимизации, что также влияет на точность и результат.

Например, различия в версиях torch, numpy, или других библиотек могут привести к разным результатам при тех же настройках.

Псевдослучайность (stochasticity) семплера

Семплер euler_a (Euler ancestral) является стохастическим — он добавляет случайный шум в процессе генерации изображения. На разных видеокартах этот шум может быть сгенерирован чуть иначе из-за различий в обработке случайных чисел.

Если начальные состояния генератора случайных чисел не идентичны (например, из-за платформенных различий), это также может влиять на результат.

Разная архитектура GPU

Различные поколения архитектур NVIDIA (например, Ampere, Turing, Pascal) имеют свои оптимизации и особенности работы с арифметикой.

Это может проявляться в разных интерпретациях одних и тех же вычислений.

У меня есличе 3060 и старая версия дров + куда 12.1 в системе

кароче эйлер говно в жопу заливает своим рандомом зависящим от карты

чекни каррас

и лцм симпл

Проще сразу сгенерить в правильном порядке, чтобы удобней было переименовывать. С пикрила сразу будет порядок - первая модель: промпты, вторая модель: промпты и так далее. С трех промптов, естественно, ничего не понятно, нужно побольше сетов или тестов, чтобы понять какая лора или настройка нравится больше.

Как считается: если всего оценивается 4 модели, то первая пикча получает 4 очка, последняя - одно. Поэтому в результате даже самая плохая модель набирает больше 0%. Можно подправить в коде, если так не нравится.

Щас качаю с хагинфейса автора натвиса https://huggingface.co/nDimensional/NatVis-Natural-Vision-SDXL/tree/main

ту версию натвиса что у него в воркфлоу называлась 68 эпохой, может она отличается всё же, хочу добиться совпадения с его пикчей.

тогда получается у нас различие из-за шедулера, а не семплера... ничего нипанимаю

>называлась 68 эпохой

это и есть в1 натвис

Странно.

Ага, контрольные суммы совпадают. Я помню когда натвис вышел я эту картинку воспроизвёл 1 в 1. Комфи поменял с тех пор что-то в себе, так что не важно.

Нам нужен третий чел с третьей другой картой для тестов

Ну кстати нойз берется с цпу на комфи есличе

Как объяснить что у нас совпали картинки? В дпм++ стабилизатор какой-то или чё? Это версия цпу же, там есть его версии на гпу отдельно.

Анончики, сгенерьте пожалуйста какого нибудь мультяшного персонажа, типа спанчбоба, только чтоб стилистика была как в мультике, не 3д. Хочу вкатиться, но интересно, может ли он нормально генерировать такое.

4я картинка итт сверху.

И вот это сделай

Видимо да, все зависит от шедулера и на разных картах дает разное.

Спасибо, заебись, годно.

Вот да, че за нода

KSampler (Inspire)

с цензурой нахуй не надо, и так уже их дофига развелось

1й пикрел автора натвиса, 2й пердолинг

https://github.com/BlenderNeko/ComfyUI_Noise

нода без реквайрментсов и без установки

самый близкий результат к оригиналу, нахуя я это делал, но теперь можно спать

https://github.com/BlenderNeko/ComfyUI_Noise

нода без реквайрментсов и без установки

самый близкий результат к оригиналу, нахуя я это делал, но теперь можно спать

Вроде как вкатился. Скачал фокус, скачал пару простых чеквеоинтов и лор, нагенерироыал всякое. Но куча неочеивдных вопросовк конечно. Иногда лора просто не делает июрабоиать. Иои еали я жоч от лоры лишл внешность человека, но поза из другой лоры, то как это расписать.

И вот я правильно понял, что я, условно, качаю флюкс, качаю чекпоинт под него, сверху этого лоры и уже потом настраиваю?

И вот я правильно понял, что я, условно, качаю флюкс, качаю чекпоинт под него, сверху этого лоры и уже потом настраиваю?

>Вроде как вкатился. Скачал фокус

выкатывайся

А че xformers в форже делают?

У меня скорость поднялась аж в 2 раза вот я охуел.

В вашем комфи такое есть, а?

У меня скорость поднялась аж в 2 раза вот я охуел.

В вашем комфи такое есть, а?

>В вашем комфи такое есть, а?

По дефолту есть.

Ты мне тут не пизди нах.

Чего тогда у меня скорость поднялась?

Когнитивная аберрация.

кто нибудь тренил лоры для flux локально? у меня самое смешное что тренировка только на комфи запустилась нормально. OneTrainer при старте лезет на хагинфейс и пытается скачать json а поскольку там надо логиниться он получает хуй. Kohya_ss версия Flux после установки выглядит как обычная версия, в ней вообще не появилась опция тренировки flux

Странно, я как-то давно сравнивал на сд 1.5, форж быстрей без xformers работал, на своём чём-то.

4070 Ti

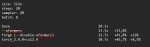

size: 512x

steps: 20

sampler: 2M

batch: 8

base20.1s

--xformers13.3s+33,8%

forge (--disable-xformers)11.7s+41,8%+12%

torch_2.4.0+cu12.410.7s+46,7%+8,5%

Ебал в рот администратора данного интернет-ресурса.

что где кого почему 512

непонятно

Ребят, помогите кто-нибудь - буду очень благодарен.

Второй день занимаюсь сексом с workflows comfyui,

Проблема с BrushNet и ControlNet - они не загружены нормально или в другом проблема...

Вроде все модели есть, но не активна кнопка выбора

ControlNetLoader:

- Value not in list: control_net_name: 'control_v11p_sd15_lineart.pth' not in []

VAELoader:

- Value not in list: vae_name: 'vae-ft-mse-840000-ema-pruned.ckpt' not in ['taesd', 'taesdxl', 'taesd3', 'taef1']

BrushNetLoader:

- Value not in list: brushnet: 'brushnet/segmentation_mask.safetensors' not in []

Второй день занимаюсь сексом с workflows comfyui,

Проблема с BrushNet и ControlNet - они не загружены нормально или в другом проблема...

Вроде все модели есть, но не активна кнопка выбора

ControlNetLoader:

- Value not in list: control_net_name: 'control_v11p_sd15_lineart.pth' not in []

VAELoader:

- Value not in list: vae_name: 'vae-ft-mse-840000-ema-pruned.ckpt' not in ['taesd', 'taesdxl', 'taesd3', 'taef1']

BrushNetLoader:

- Value not in list: brushnet: 'brushnet/segmentation_mask.safetensors' not in []

а если нажать на название модели пусто? тогда модели лежат не там где надо или их вообще нет

если не лень, напиши мне в тг - @vallborodin

я все проверил, один хрен - не грузятся :(

модели брашнета в ComfyUI\models\inpaint (можно в подпапках как на странице установки пик1 указано)

vae в ComfyUI\models\vae

контролнеты в ComfyUI\models\controlnet

и никакой кириллицы в полном адресе не должно быть

показывай командную строку

странно, нет папки inpaint, vae и controlnet есть

что значит кал? это охуеть как красиво

Нашел интересный пак нод https://github.com/chrisgoringe/cg-noisetools, позволяющий управлять формой шума. Результаты очень интересные, выросла консистенция и адхеренс к промту.

До, после. Если еще атеншнер включить то вообще еще лучше, пик3.

Все на 15 шагах без негативов с дмд, настройки нойза пик4

До, после. Если еще атеншнер включить то вообще еще лучше, пик3.

Все на 15 шагах без негативов с дмд, настройки нойза пик4

анон, спасибо тебе, оочень помог, все починилось

point + sin

sin + point

sin + sin

w0.5 point + w0.5 sin

Это похоже на работу вариатора но гораздо лучше и почему-то не работают негативы лол

Еще пример.

tv show 1980s, Little girl, holding_basket, horses around

до после

fighting of two men in office

woman lying on the grass

До после

В чём разница между чекпоинтами, ембедингами и рефайнами?

чекпоинт просто любая полная модель

ембединги дополнительные фиксированные наборы векторов, которые добавляются к текстовым или визуальным входным данным, не изменяют веса модели, устаревшая хуйня

рефайн это метод двухпроходной генерации когда тот же чекпоинт или другой докручивает за моделью на первой стадии генерации, уточняет и добавляет детали, работая на более высоком разрешении

woman lying on the grass, yellow bikini, sunshine, cola bottle on the grass

пик 1 дефолт

пик 2 шум + атеншнер

пик 3 дефолт + атеншнер

если че атеншнер seg

Я тут окончательно пересел на линупс и чет прихуел, форжа работать стала ебошить явно быстрее, а вот уютная дрысня с макаронами нихуя.

Позу старайся задать промтом, а лицо через Лору, никогда не ставь вес больше чем: 0.8, в каждом сиде свой базовый хлебальник, вопрос лишь в том, насколько он будет совместим с лорой, в случае когда нет дисонанса результат будет нормальный. Тут есть качели, чем сильней понимаешь вес Лоры, тем перс будет больше похож, но датасет у Лоры меньше, чем датасет модели, и поэтому выражением лица будет управлять тяжелее, морда будет все время кирпичом. Любая лора одежды содержит свой датасет со своими бабами, и они будут оказывать свое влияние на твоего персонажа, так что использовать их надо аккуратно, начинать с очень маленьких весов, по чуть-чуть поднимая и наблюдая, за тем будет-ли меняться персонаж. Про флюкс забудь, он требует ебануться каких ресурсов по железу. За один проход редко картинка получается на 100% готовой, всегда нужно уточнять лицо, руки, элементы одежды через импайнт. Как понял?

обе, только сега, дефолт

просто сега лучше. как и зачем этой шумодрочилкой

еще проще для теста концепт выбрать не мог, стекломойный?

бля у тя еще и размер дефолт...

woman drinking cola, coca cola advertisement poster, x-mas

Дефолт + сега, шумы + сега

ебашь cartwheel, помойный чухан

на 1536 и 1280 хуйня безбожная получалась, хуже чем на голом анусвизе

>1152x896

>не дефолтный

ты далбаеб сука чтоли или что это дефолтный, укладывается в 1,048,576 - 1024x1024

>woman drinking cola, coca cola advertisement poster, x-mas

>сосем хуй

>сосем хуй

>курим колу

>сосем хуй

как же натвис ебет

Пшел на хуй дебил. Где в твоём первом посте слово про размер? В головушке твоей опять? Да и всё рано пшёл на хуй. Генерироваю что хочу.

Я не стал постить про дерущихся мужиков в офисе. Они дрались за хуй и часто дрались хуями))).

Натвис такой натвис.

> про фобкс забудь

А что такого он требует? 4080? Или даже больше? Я там еще увидел fp8 flux, она как?

> как понял

Вроде понял.

>на 1536 и 1280 хуйня безбожная получалась, хуже чем на голом анусвизе

Скилишью

нойзмикс клевый

Ну и вопрос насчет фокуса. Если ставишь чекпоинт, то модель нет смысла вставить? Чекпоинт дополняет модель, или она standalone/самостоятельна?

>насчет фокуса.

насчет фокуса - дропай его нахуй, самый ублюдский UI, все профессионалы 40 лвл итт сидят в https://github.com/comfyanonymous/ComfyUI

>Если ставишь чекпоинт, то модель нет смысла вставить?

> Чекпоинт дополняет модель, или она standalone/самостоятельна?

чекпоинт и есть модель, работает самостоятельно, к ней подключаются дополнительно дополнительные модели с концептами в виде лор и прочие мокрописьки

Есть ли шанс поюзать понихл на лаптопной ртх3050 или хуйня затея? Тупо падает фордж в тщетных попытках что-то нагенерить.

Я тупой, и Комфи кажется мне сложным

> прочец микрописьки

А какие еще, кроме лор, есть?

А так, я про флюкс спрашивал, ибо сейчас на SDXL. Или SD1.5.

Какие требования у флюкса?

Нифига непонятно. Ещё пони есть, на который очень много контента

>и Комфи кажется мне сложным

Ничего сложного, все что тебе нужно знать для базовой работы на пикриле.

>А какие еще, кроме лор, есть?

Да много чего, контролнеты, ипадаптер, брашнет, раунет/дипшринк, атеншнеры, апскейлеры...

>А так, я про флюкс спрашивал

>Какие требования у флюкса?

Флюх все равно на факасе не запустится, тем более тебе нужно в комфи топать, т.к. там есть поддержка квантованных гуфов и залезет в нищенскую карту в целом или с оговорками по времени смены моделей. Вот у тебя какая карта?

>Ещё пони есть, на который очень много контента

Ну пони это сдхл бейзд.

>Есть ли шанс поюзать понихл на лаптопной ртх3050 или хуйня затея?

Да, держи https://huggingface.co/YOB-AI/PDXL-FP8/tree/main

Работает даже на 4 кеках.

Ну и нахуй ты мне скинул ентри левел для детсадовцев?

Я про нагромождение макарон как в факторио

Там у челов вообще какие то непонятные функции непонятно че делающие но без них типа картинка кал получается

> вот у тебя какая карта

4070.

> >и Комфи кажется мне сложным

> Ничего сложного, все что тебе нужно знать для базовой работы на пикриле.

Ну так выглядит просто. Разве что непонятно, почему VAE модель отдельная нужна. Как я понял VAE из пикселя в шум и обратно переводит. А зачем тут модель то нужна?

> Да много чего, контролнеты, ипадаптер, брашнет, раунет/дипшринк, атеншнеры, апскейлеры...

Кроме последних двух остальные для меня новые инструменты

> Ну пони это сдхл бейзд.

Лоры взаимозаменяемые?

>4070

Ну вот, у тя 12 гигов. Если тебе нужен флюх то идешь качать

базовая модель https://huggingface.co/city96/FLUX.1-dev-gguf/tree/main

t5 https://huggingface.co/city96/t5-v1_1-xxl-encoder-gguf/tree/main

+ докачать clip_g и clip_l (они весят 1.6 гига вместе) + 327 метров вае флуха

Допустим берем квант основной модели Q4KS это 6.81 гига, берем клипг и клипл на 1.6, качаем вае на 327 метров, остается 3.2 гига на т5, значит берем T5 в кванте Q4KM, итого у тебя полноценная модель без выгрузов частей на рам будет в карте висеть.

> почему VAE модель отдельная нужна

Это просто чтобы понимать что ее можно отдельно, если она в модель не запечена. Допустим во флюхе она так отдельно подключается.

>Как я понял VAE из пикселя в шум и обратно переводит.

Вае переводит из пикселя в латент если у тебя есть входное изображение. Если его нет то изначально берется латент на основе сида.

>Лоры взаимозаменяемые?

Только работающие с архитектурой (убыстрялки) и совсем редкие типа адддетайлс насколько я помню, в остальном нет, для пони нужны свои натрененные на пони лоры.

Ты тоже не красавчик если кропать твое ебало.

>еще поддерживаемый форк ранее популярного WebUI от Automatic1111 (R.I.P)

>(R.I.P)

Почему?

>(R.I.P)

Почему?

Чем можно ускорить флюкс? Накатил его на Forge и пиздец как он медленно генерит, в 20 раз дольше чем поня.

Я понаставил ускорялок по гайдам (vae + клип энкодер), но мне кажется что они нихуя ни на что не влияют. Разве что fp8 диффузия даёт быстрый результат в виде отказа вычислять картинку, но это не тот вид скорости, который кому-либо интересен).

Можно списать тормоза на нищую видеокарту 4GB, но я погуглил - на форумах 32GB бояре жалуются, что картинку им выплёвывают спустя пять минут, а не две секунды.

У кого-нибудь есть опыт сравнения комфиуи и форджа?

Я понаставил ускорялок по гайдам (vae + клип энкодер), но мне кажется что они нихуя ни на что не влияют. Разве что fp8 диффузия даёт быстрый результат в виде отказа вычислять картинку, но это не тот вид скорости, который кому-либо интересен).

Можно списать тормоза на нищую видеокарту 4GB, но я погуглил - на форумах 32GB бояре жалуются, что картинку им выплёвывают спустя пять минут, а не две секунды.

У кого-нибудь есть опыт сравнения комфиуи и форджа?

Если че воркфлоу для работы с гуфами несколько другой для флуха. На примере шатл (файнтюн флух шнели) но принцип тот же.

Какая сложная схема то. Но вроде понятно. Вернусь домой буду пробовать.

Я еще слышал, что генеративные сети очень чувствительны к памяти, и выгрузка на вторую видеокарту уровня р1000 или р102-1000 очень серьезно отразится на скорости. Это так?

У тя на пикчу 2 часа генерило лол? Ебать ты терпишь.

>Чем можно ускорить флюкс?

Ну ты сравнил, сверточный юнет против рфлоу, RFLOW архитектура флуха не оптимизнута нихуя и считается гораздо труднее для карты, так что только купить норм карту 4090, чтобы ощутить себя человеком.

>но мне кажется что они нихуя ни на что не влияют

Да.

>в 20 раз дольше чем поня

>Можно списать тормоза на нищую видеокарту 4GB

ну то что у тебя на четырех гигах вообще что-то работает уже чудо, даже если взять во внимание что у тебя ублюдский nf4

дело в том что у тебя веса ни одной из частей модели не помещаются в карту полностью и отгружаются в рам, поэтому происходит ебейшее падение производительности

теоретически на 4 гигах можно попробовать частями грузить квант Q2K который весит 4.03 гига, но сам понимаешь даже он тебе залупу покажет

А так тебе одна дорога на SD 3.5 Medium, она и работает быстрее и в карту твою говеную влезет, и генерит она не так ательешно приторно как флух https://huggingface.co/city96/stable-diffusion-3.5-medium-gguf/tree/main

>У тя на пикчу 2 часа генерило лол? Ебать ты терпишь.

Я пообедал и погулял за это время, специально оставил эксперимент на время, когда пекарня простаивает.

Но похоже, флюкс до обновы пекарни не подойдёт в мой пайплайн.

> ну то что у тебя на четырех гигах вообще что-то работает уже чудо

Я тоже был удивлён, насколько за год лучше стала оптимизация.

Раньше мне приходилось руками вписывать аргумент запуска что-то уровня "low vram", сейчас нехватку видеопамяти автоматически детектит (и в консоли на каждом тике попускает).

> так что только купить норм карту 4090, чтобы ощутить себя человеком.

Всё так. Просто флюкс, похоже, даже владельцам топовых карт может дать пососать, если его неправильно готовить.

> насколько за год лучше стала оптимизация.

Это кожанка обнову выкатил год назад на драйвера, вместо OOM вылета теперь автоматом все невлезающее сгружается в рам и ждешь вечность. Оптмизация яебу.

Пять минут на картинку ещё по-божески.

Хотя иногда мне совсем малости не хватает до 1536 МБ.

Анон, у меня генерит 20 шагов 1 мин на моём ведре и это пиздец долго, НО. Оно того вообще не стоит, поверь. Пикрел - частота генерации у меня на флюссене. Блюр, сфв, жопаборода, дженерик ёбла, неестественность композиций, нихуя селебрити не похожи на себя, понимание стилей на уровне 1/10 от базовой сдхл. Ну хуй знает почему я ещё не снёс этот кал.

>что генеративные сети очень чувствительны к памяти, и выгрузка на вторую видеокарту уровня р1000 или р102-1000 очень серьезно отразится на скорости. Это так?

Не совсем так. Сетки чувствительны к памяти когда ее нехватает, тогда веса сгружаются на рам и ты сосиошь как тут

Фактически ты можешь части модели рассовать по разным картам (есть ноды специальные для этого), но поделить условную модель с весами которая весит например 7 гигов на части нельзя будет.

Юзкейс примрено такой: на одну карту идут веса размером 7 гигов, на вторую т5, клипы и вае, итого будет то же самое как использовать одну карту но с использованием двух разных карт.

Это касается картиночных. На ллмках можно послоям на карты раскидывать, чем успешно и занимаются.

>она как?

Она не умеет в еблю, вообще флюкс в целом не умеет в еблю, он даже соски не может нормально нарисовать. Так что пока флюкс идёт лесом. Портретики-хуетики, ок, но не больше. Вероятно это не надолго, и кто сделает что-то на базе него, но не завтра, так что забудь пока и голову себе не забивай. Также не слушай ебланов с проводами, это ебаные сектанты, им нужен тот кто им будет в рот заглядывать и теребонькать их чсв. Ты для них 0, сам по себе. Как понял?

>Также не слушай ебланов с проводами, это ебаные сектанты, им нужен тот кто им будет в рот заглядывать и теребонькать их чсв. Ты для них 0, сам по себе. Как понял?

хуя себе факассина рванула

Получается комфи для элиты, а фокус для заводчан?

Ну про ллм я знаю. Потому и спрашиваю.

А то, что видеокарты будут из разных поколений, Ада и Паскаль, насколько сильне скажется на скорости?

Да и имеет ли смысл,честно говоря?

А фордж для кого?

Комфи для тех кто хочет делать как он хочет, а факас для домохозяек, которые посмотрели видос инфлюенсера про "мижорни у вас дома одна кнопка шедевры бред питт" и восхитились.

Фордж для потеряшек во времени.

Это тот же фокус по сути. Фокус это собирательный образ вебюай с фиксированным конфигом, где можно только выбрать из того что илюша одобрил. Это как айфон, где барин решат что для тебя лучше всего, а не ты.

Скорее для мазохистов. Я был наслышан о НЕВЕРОЯТНОЙ СЛОЖНОСТИ комфи для подпивасов, а когда сам пощупал — охуел. НАСКОЛЬКО же комфи, блядь, понятнее и приятнее ебаного фарша, просто небо и земля нахуй.

>для заводчан

для начинающих. потом если не сблеванёшь можешь потихоньку ковырять это корявое говно, пока очередная ещё более кривая обнова разъебёт всё к херам и оно перестанет даже загружаться) Тебе нужно для начала разобраться с общими принципами, понять как и что работает.

Так ребята, хорошо поработали сегодня во славу комфи. Подходим по очереди, +15 базов. Горжусь вами.

>А то, что видеокарты будут из разных поколений, Ада и Паскаль, насколько сильне скажется на скорости?

Ну там принцип что то что ушло на карту, то на этой карте и будет считаться. То есть т5 на одной карте будет считаться, а сам просчет генерации после обработки клипа уже будет делать карта с весами модели. В принципе никак на скорость не повлияет, разве что пару сек времени добавит на перенос инфы по шине псие с одной карты на другую через рам.

>Да и имеет ли смысл,честно говоря?

Разделять модели по картам? Ну если у тебя две карты одна 16 гигов, а вторая 8 то по сути у тебя одна карта на 24 и ты берешь условный флюх Q8 в 13 гигов (потери от фуовой модели вообще незначительны), на другую кидаешь клипы, вае, и Q8 Т5 (сейм по потерям от фуловой т5) и у тебя еще остается сверху на то чтобы генеритьразрешение повыше и поключать лоры и всякие мокрописи.

>барин решат

барин решает и он же отвечает, стая бешенных макак ни за что не отвечает.

они тоже не понимают. просто так спиздили где-то не разбираясь,

так бы маленький лагман был

сконвертил модель в рт и генерация соснула в 4 раза

что я сделал не так?

что я сделал не так?

над прогресс баром ошибка, гугли

какие вводные? сколько гигов карта? динамический рт или статический? покажи воркфлоу

Если делал динамик и у тебя меньше 12врам то делай статик, иначе будешь сосать.

у меня dyn-b-1-1-1-h-576-1728-1024-w-576-1728-1024 наоборот меньше врам занимает чем сам чекпоинт

Мдаа... Почему так нахуй?

3060 народная карточка а всего 1.4ит в сек...

На некоторых семплерах так вообще 2 секунды на ит

Так жизни не будет надо походу на 1.5 перекатываться с 18 картинками в сек как на том графике..

3060 народная карточка а всего 1.4ит в сек...

На некоторых семплерах так вообще 2 секунды на ит

Так жизни не будет надо походу на 1.5 перекатываться с 18 картинками в сек как на том графике..

Ты не понял. Динамик жрёт больше врам чем такой же чекпоинт не тензоррт. Отжор будет больше, но скорость выше.

Выше ит/сек тем лучше, алё. Ты тот ллмщик чтоль? Привык что N-секунд на токен лучше меньше чем больше, небось.

перечитай мое сообщение

А для чего нужны клипг и клипм, и Т5?

Хуя ты мастер дислексии. Ну ок.

Локальный клип, глобальный клип, т5 трансфррмер ллм. Все три переводят твой пердежный промт в понятные для сети цифорки. Флюхговно не умеет работать с клипами без т5, в отличие от сд3.5, так бы можно было сэкономить врам и не юзать т5.

А я думал этим вае занимается. Что тогда на входе делает вае?

> все три

А каждая отдельно что делает?

> А я думал этим вае занимается. Что тогда на входе делает вае?

Если нет входного изображения, то ничего. Если есть входное то преобразует в латент спейс (сеть работает с латентным шумом, а не пикселями). На выходе преобразует из латента в пиксели.

> > все три

> А каждая отдельно что делает?

Г глобальное понимание контекста, л детали и точное соотствение изображения описанию, т5 улучшает промт чтобы сеть понимала что где зачем в какой форме и нахуя находится.

Я наверно задолбал вас мвоими тупыми вопросам.

А что из себя с точки зрения информатики представляет латентный шум. Или это уже углубление слишком и не здесь мне спрашивать про это?

ало на вашей залупе макаронной не работает киллер фича

на гитхабе уже 2 чела пожаловались

в форже кстати тоже, скачал аутоматик тут все норм

> А что из себя с точки зрения информатики представляет латентный шум.

многомерное сжатое пространство признаков, в котором данные представляются в числовых абстракциях

А подробнее про это где можно почитать?

В папере к любой нейросети

Голову не забивай, пиши в промпт 1girl и понеслась. Потом по ходу дела поймешь что к чему.

нет, я всё правильно понял

я взял чек нубрил, он жрёт 8 примерно, перподключаю лапшу модел на тензоррт и жрёт меньше 7

лашара, ахаха, 3 дебила у которых руки совсем уж из жопы ноют

Если одно и то же слово написать в промт и негативный промпт, то кто победит?

Как приятно перекидывать провода, чувствую себя электриком такой кайф, захожу не для генерации, нахуя она нужна, у меня и видяхи то нет, дайте мне провода покидать.

мимогомфи

Я тоже не могу оторваться, иной раз так хочется узелок на память завязать, что-бы хлеб не забыть купить. Я это дело ещё в детстве полюбил. когда на курсы макромэ ходил, мама настояла, я поначалы брыкался, а потом каак втянулся, потом ещё вышивать крестиком начился и дружил только с девочками, но они меня не привлекали.

Конечно позитивный. У негатива влияние в генерации небольшое, это не 100% вычитание далеко.

Факас поговорил сам с собой

@

День прожит не зря

@

Не в факассе долбить бреда питта же

https://blog.comfy.org/ltxv-day-1-comfyui/

2b модель для генерации говняных видосов на вашем говне, говнюки

121 кадров за 12 сек на 4090

2b модель для генерации говняных видосов на вашем говне, говнюки

121 кадров за 12 сек на 4090

Забей. Просто качай сд и сри в тред про флюксокал, как делают это все нищие и кривые итт. Это путь. Может когда-то заработаешь денег, тоже сможешь генерить готовые сложно-промптовые пикчи за 15-20 секунд. Нужно всего 30-50к рублей, бюджетная видеокарта на 12-16ГБ.

Как будто флюксокал не флюксокал и его не выебал сд 3.5

не обязательно текстовый енкодер от пиксарта кста, можно ебануть обычные кванты гуфа

Используй Easy Training Scripts, треню давно, проблем нет, ветка flux.

Когда уже наконец банальные лупы с еблей и отсосом можно будет генерить?

на когфан чето связанное с лорами запилили, глянь туда

>когфан

куда

Затестил LTX. Качество лучше китайцев, в основном мутантов генерит из-за всратого VAE, но это уже уровень первых версий SD, что-то осмысленное можно генерить. Скорость хорошая, 1 секунду генерит за 3-4 секунды. VRAM жрёт ультрамало, меньше 10 гигов.

Анончик, подгони, пожалуйста, простенький воркфлоу под комфи, чтобы просто работал и не выёбывался. Работяга хочет генерить мультяшных девочек и шоб ёбла не колбасило сильно...

Дай угадаю, опять говно с генерацией только по промту?

Нет...

ДА ХУЛИ НЕ РАБОТАЕТ НИХУЯ БЛЯТЬ

Что. Я. Делаю. Не. Так?

Ебля прям как на амд сука

Что. Я. Делаю. Не. Так?

Ебля прям как на амд сука

Почалося?

Ладно я ПЕРЕУСТАНОВИЛ ВИНДУ.

Что нужно скачать перед скачкой comfyUI чтоб все работало?

У любой нейросети свой шум с общии принципами, или даже принципы и свойства этого шума различаются?

> module onnx is not installed

Я щас ебанусь

Почему я не могу

На нвидии

3060

Просто

Установить говно

Чтобы оно работало

патамушто у тибя руки из жопы. местные питушки любят ишшо говарить "скилишуе" на сваем новапидорскам

>А подробнее про это где можно почитать?

Не всё, но хорошее объяснение https://huggingface.co/blog/TimothyAlexisVass/explaining-the-sdxl-latent-space

Не пизди хуесос

Я делаю тоже что и все

Пони и по вкусу несколько лор на стиль/персонажей.

Я пользуюсь дополнительно лорой easynegative (подключаю к негативному промпту), но иногда всё равно генерит уродов и артефакты.

> Я был наслышан о НЕВЕРОЯТНОЙ СЛОЖНОСТИ комфи для подпивасов, а когда сам пощупал — охуел. НАСКОЛЬКО же комфи, блядь, понятнее и приятнее ебаного фарша, просто небо и земля нахуй.

Пощупал комфи, вообще не вижу преимуществ перед форджем на небольших сценариях генерации.

Это надо сильно хитровыебанный комбайн собирать (например, генерить картинку, распознавать на ней положение нейронного недо-текста и замещать его на фразу ТЫ ПИДОР).

Покажите самый хитровыебанный, но всё ещё полезный пайплайн на комфи, кстати.

>тоже что и все

ага. винду переустановил, вместо того чтобы консоль почитать и разобраться в ошибках. или скинуть их сюда, вместо пикрил унылого скрина. уже одно это показывает какой ты долбоеб.

Разница в скорости при запуске на винде и с линукса есть?

У чела на пике есть учебники по С++?

У меня и не должно быть никаких ошибок тем более на свежей винде

Мне говорили на нвидии пердолинга нет и тут кнопку нажал и все работает

Пробовал этот модуль поставить?

Аноны с 3060 скажите какой у вас драйвер на видюхе и версия комфи

Да там еще ошибок вылезло я че программист нахуй

А разве изинегатив и подобные штуки нужно кидать в папку для лорок, а не в папку эмбедингс?

Как же тяжело с этим комфи, сплошной пердолинг

Потому я старовер, уже напердолился в А1111, всё настроено, и заново ну нахуй. ОДНАЖДЫ может, а пока генерится - генерится.

Пиздец в нубаи конечно что ни слово, то подпись автора блять. Аж трясёт.

Новая версия комфи ломает воркфлоу нахуй. Если переключиться между табами с воркфлоу, то он не сохраняет изменения и сбрасывает на состояние до изменений. Так же не работает иногда сейв воркфлоу, сбрасывает нахуй. Пидорасы криворукие. Джва часа ердолил воркфлоу, переключил таб и всё сбросилось сука.

У нас сегодня день пердолинга с комфи? Тоже сейчас решил новую версию накатить и 2 часа проебался, мое воркфло фризило по 2 сек, я заебался настроечки тыкать, ноды частями удалять, браузер другой поставил, оказалось они исправили баг в новом фронтенде. https://github.com/comfyanonymous/ComfyUI/issues/4820

Еще эта панелька теперь внизу всегда, я уже привык что она вверх съезжала. А новая занимает много места просто так и неудобная.

Еще эта панелька теперь внизу всегда, я уже привык что она вверх съезжала. А новая занимает много места просто так и неудобная.

Easynegative импортер с civitai скачивал мне в папку с эмбедами, но мне удалось заставить comfyui его видеть в лорах, только положив в папку с лорами.

Сейчас попробую сгенерить картинки с ним и без него с почти пустыми промптами, чтобы посмотреть на разницу.

Да, изинегатив в папке с лорами нормально себя показывает. Я отрубил его, и мне стало генерить вот такое.

Да ебанные овцы, специально для хлебушков есть же "StabilityMatrix", поставил и некакой ебли. Нажал одну кнопочку и комфи поставился, нажал вторую и генери 1гирл стендинг хоть до устрачки!!! Хули вы мозги ебете и себе и окружающим.

А как ты генеришь тексты в вывесках и прочих встроенных надписях? Я откопал узел оверлея на гитхабе (результат пикрил), но он сильно не про это.

Вот бы сд3, альтернативу flux fill представили

Напомнило как я откапал узел в своей жопе и вправлял его, с тех пор стараюсь редко есть острое. У тебя тупо оверлей с текстом, а не вписанный в композицию сгенерированный текст. На фоне шакальной картинки с распидарасом анатомии выглядит кринжово. Удали.

Какой-то кисель на картинке. Удали.

Так это же базовая генерация СД3.5, тут только слово "sd3" заинпейнчено флаксом

Бля, как же заебала эту хуита. Эти криворукие макаки вообще знают что такое тестирование и почему стейбл версия называется стейбл? Ебать, они выкатывают в стейбл говно с багами я такое впервые вижу на гитхабе у более менее массовых продуктов. Это уровень васяна с форча.

Я на SDXL генерю, она в тексты неочень, даже лоры непомогают особо, так что я забил на текст...

Долбаебы в чем проблема откатиться

>websocket_image_save.py

Удаляешь эту хуйню, а она САМА подгружается прям как в ФОКУСЕ, ты не можешь взять и просто отказаться от этой говноноды.

>НУ И ЧТО НУ И ПОДУМАЕШЬ НЕ ПРОБЛЕМА ПОТЕРПИМ А ЧЁ

Удаляешь эту хуйню, а она САМА подгружается прям как в ФОКУСЕ, ты не можешь взять и просто отказаться от этой говноноды.

>НУ И ЧТО НУ И ПОДУМАЕШЬ НЕ ПРОБЛЕМА ПОТЕРПИМ А ЧЁ

ХЗ ваще ноль проблем с новой версией, новый UI топ

Шёл 2024 год, васян-говнодел так и не смог внятно поязнить нахуя подчёркивание в конце имени файла ComfyUI_00010_.png и если самому скрипты править чтоб убрать, то идут по пизде кастомноды, где учитывается имя файла.

ну если ты дефолтными настройками пользуешься, то может и норм, стоит чуть под себя настроит просто настройки комфи, то уже всё летит на хуй, кто вообще говорит про стиль епт, новое меню мне так-то зашло

В пизду, качаю версию 0,01 я теперь старовер.

>потерпим

Так тебе как раз и предлагают не терпеть, а сделать шоб всё было норм.

Ты как те долбоёбы, которые в игрушечках для дебилов ставят 8X MSAA или что там сейчас актуально в 4К, а пользовать длсс и фреймген им не позволяют религия и гордость.

>а пользовать длсс и фреймген им не позволяют религия и гордость.

Длсс это даунскел картинки, ясное дело мммса всякие будут качественней.

DLSS это как раз апскейл в нативное разрешение, предварительно уменьшенного разрешения.

Качественней. В 12 фпс.

Если есть проблема, которая на стороне юзверя решается в 2 клика, но тот её решает не собирается, то юзверь не меньший долбоёб, чем разраб, пропустивший эту самую проблему. Только вот разраб довольно скоро проблему пофиксит, а юзверь такой долбоёб на всю жизнь.

> Это уровень васяна с форча.

Лол, если вдруг не вкурсе, то так оно и начиналось в форчевском /g/, плюс ещё нарратив подсибя и под линукс с амд был в первый месяц

Ты дебил. Вот тут гайд для дибилав https://huggingface.co/YOB-AI/3060-TensorRT-v10.6.0

Не работает, сломалося, но блять что может быть лучше этого? Собственно, критикуешь - предлагай, у меня когда что-то не работает - пытаюсь найти решение, что конкретно сломалось, читаю последние коммиты и на гите стараюсь отписать, чтобы починили. Вот вы такие интересные...

Что сломалося я нипонял? Вчера обновился на новый релиз изза сетки которая видосы генерит, ниче не сломалось, все работает как часики.

560.94

ласт комфи

куда 12.1

У меня то все работает, там выше были посты с какими-то ахуевшими запросами к open source проекту. Я же наоборот восхищаюсь божественным комфиком

Затестил, годно.

А как видео генерировать посоветуете?

Как правильно на английском описать плотное квадратное телосложение, примерно как у дворфа, или как у этой бабы из Опенгеймера?

korenastaya body

>выше были посты с какими-то ахуевшими запросами

там дебил не смог разобраться как ставить отсутствующие в встроенном питон пакете комфи модули, это я понял

еще у второй (или этой же) криворучки чето в воркфлоу при переключке табов и фризит - у меня все ок, это я понял

так че сломалось то глобально? ниче не сломалось

Нехватает 1герл? Держи, правда без квадратного ебала и жопы на подбородке, наверно это большая потеря для любителей флюхкала.

>базовая генерация СД3.5

Это 3.5 медиум, 20 сек на ген, текст на низких квантах без ошибок, здоровье, благополучие, выебанный флюх.

Ебало мерзкое пиздец, конечно, переделывай.

Как заставить эту панель быть всё время закреплённой снизу, а не каждый раз болтаться в воздухе при запуске комфи? Заёбывает каждый раз её вниз прикреплять. Может где-то в скриптах питона нужно подправить?

Опять наебалово. 100степс, остальное дефолт. 4070 Prompt executed in 101.86 seconds

Выебан то выебан, но инпейнтить на уровне flux fill пока все равно не умеет

Проще некуда, берешь модель, берешь на выбор модельки https://huggingface.co/YOB-AI/DMD2MOD/tree/main, генерироваешь, негативы не нужны, или нужны в минималке уровня ворст кволити (конкретно для нубая)

дипшринк опционален, если генеришь огромные полотна одним проходом

У меня не открепляется после перезапуска. Панелька наверху, там же и кнопка гена вставлена.

Ну стабилити обещали для 3.5 пачку оффициальных контролнетов. Ждем. Кекфорест вон пустя почти полгода свое говно высрали ток.

А если локалстораж и куки почистить?

Аналогично, git pull 5 секунд назад, ничего не открепляется

В хуйнях такого уровня я разобрался, но вне зависимости от разрешения и семплинга нахуй идут глаза и мелкие детали. При попытке сгенерить что-то с жЫрным лайном этот самый лайн колбасит и рвёт. Апскейлы делают только хуже.

Вот на цивитаи есть какой-то хайрез-фикс. Вроде апскейл, а вроде и не апскейл. Что это и как можно сделать подобное в комфи? Это такой рефайнер или я тёплое с мягким путаю?

Ждем, хз че ты так флакс хейтишь, мне кажется, если бы не он, то стабилити и 3.5 не выпустили нифига. Короче и там и тут есть приколы, я вот пока не нашел применения для 3.5

>Вот на цивитаи есть какой-то хайрез-фикс. Вроде апскейл, а вроде и не апскейл. Что это и как можно сделать подобное в комфи? Это такой рефайнер или я тёплое с мягким путаю?

Ало ебать, дипшринк и его замена опциональная в виде raunet это часть хайрезфикса, вторая часть хайрефикса это имг2имг проход обычный.

>но вне зависимости от разрешения и семплинга нахуй идут глаза и мелкие детали. При попытке сгенерить что-то с жЫрным лайном этот самый лайн колбасит и рвёт.

У тебя скилишуе.

?

>нет подписи yello

Ясно...

Шпашибо, держи добра и нефти

Скиллишуе скиллишуем, а в локальной генерации ползти до уровня цивита по ощущениям даже тяжелее, чем при игре в osu, когда переходишь с мышки на граф планш.

>до уровня цивита

Т.е. до уровня ниже дна? Или просто ниже уровня говноделов из /б?

Да

может кто знает как повысить скорость обучения flux lora на своем компе? в comfyui 60 s/it, через flux_train_network.py 80 s/it

> 100степс

Нахуя? 30 достаточно. Если разрешение побольше сделать, то чуть получше с качеством. Промпты обязательно должны быть длинным текстом, а не тегами. Ну и скорость очевидно про 4090, 5-секундный видос генерит за 25 секунд.

Реализуем ли motion brush? Чтобы анимировать часть статичного изображения или только полный img2img?

Если запромптить сможешь. Вообще довольно чётко границы объектов определяет.

Вот это реально мощно!

>вне зависимости от разрешения и семплинга нахуй идут глаза и мелкие детали

так нужно делать второй проход на среднем денойзе, там же можно повысить разрешение именно на данном этапе, так как чем больше пискелей на объект в картинке, тем лучше он прорисовывается.

>Вот на цивитаи есть какой-то хайрез-фикс. Вроде апскейл, а вроде и не апскейл. Что это и как можно сделать подобное в комфи? Это такой рефайнер или я тёплое с мягким путаю?

Эта фича изначально выдуманная в Automatic1111, в принципе не отличается от того, что я в этом посте описал.

Приблизительно вот так можно воспроизвести его https://comfyanonymous.github.io/ComfyUI_examples/2_pass_txt2img/

>хз че ты так флакс хейтишь

Так а че он такой тормоз и весит дохуя. Хуй с ним с качеством как у сток фото и незнании множества концептов, не базовая модель, понимаю, но так медленно работать и сувать 12 лярдов параметров когда никаких профитов от этого нет по факту - но мерси.

>Эта фича изначально выдуманная в Automatic1111

Эта фича вместе с дипшринком придумана коёй https://gist.github.com/kohya-ss/3f774da220df102548093a7abc8538ed

Алсо, хайрез фикс - буквально фикс для того, чтобы предотвратить проебку картинки на высоких разрешениях.

Тебе тут писали про дипшринк и прочие альтернативы, но это уже манипуляция латентом, которая часто проводит к проебу пропорции на не квадратном соотношении сторон у картинки (так как ты фактически не можешь настроить денойз на латенте).

Лучше сделать нормальную картинку без всего этого на первом этапе генерации, а потом пройтись по картинке еще раз повысив ее разрешение, так будет меньше проебов в пропорциях (так как денойз контролируется в отличие от дипшринка).

Конечно блять нахуй.

Автоматик запилил ее еще до того, как все вкатились в SD, включая и Кохуй-я.

Потом уже начиная с Кохуя все начали хайрезфикс переносить на латенту, в которой она почти всегда проебывается.

какие же все эти маняпуляции с промпт клипом таргет резолюшен 4к епт скор квалити 8 епт, элитными шедулерами для избранных сраный плацебо аутотренинг дебилов нахуй не умеющих в промпт. Тупо на дефолтных настройках всё достигается. ШУМЫ-ХУЮМЫ блять все эти дрочильни с ОСОБЕННЫМ шумом с гпу ой бля, нененне не дефолтный ксемплер а надо мейдвасянвиайпи там ух уникальный шум такой шумочек нямка

>нужно делать второй проход

Ты имеешь в виду передать latent с одного сэмплера дальше на ещё один? Получается какая-то горелая хуйня. И чот не могу вкурить, как на этом этапе разрешение повысить, кроме как апскейлером. А может и понял уже, сейчас буду проверять свою догадку

>Автоматик запилил ее еще до того, как все вкатились в SD, включая и Кохуй-я.

Что тебе непонятно в формулировке "Эта фича вместе с дипшринком"? Или ты дебил ебучий понял это как "хуйрез фикс придумал коя"? Это же тупизм, сказать "придумал двухпроходный имг2имг" все равно что сказать "придумал нажимать кнопку генерейт", моск включай хоть иногда, дважды картнку прогонять это база и так всем известная, а дипшринк к ней присобачил коя.

Сорян, я так и не понял, что делает дипшринк. Никакого эффект на результат не заметил. Пытаюсь курить матчасть дальше.

>я так и не понял, что делает дипшринк. Никакого эффект на результат не заметил.

вапроси?

Самовнушение.

анон, что эти буквы в скобках у лоры значат, как расшифровать?

>Ты имеешь в виду передать latent с одного сэмплера дальше на ещё один?

Нет, самый старый но надежный метод который работает еще с 2022 года - оригинальный hires.fix - ты сначала получаешь картинку как положено, потом увеличиваешь ее разрешение либо тупо растягивая до нужного количества пикселей либо применяя простую модель esrgan модель для этого, полученную картинку с большим количеством пикселей енкодишь через VAE Encode и получаешь латенту, которую суешь в другой сэмплер в котором ставишь величину денойза чтобы накинуть шума на картинку в зависимости от того, насколько ты хочешь чтобы картинка изменилась (к примеру среднее значение 0.4). Но тут надо понимать, что насрав шумом ты можешь получить искажения, а недосрав шумом нейронка слабо обработает картинку.

>дважды картнку прогонять это база и так всем известная,

значит ты не сидел тут с 2022 г. молокосос

Все деды тут знают, что хайрезфиксом всегда была галочка, которую подключали при генерации в Automatic1111 еще за год до того, как Комфи и прочие начали клепать свои УИ.

Уже потом, когда начали понимать процесс (так как Автоматик не делал свое вебуи понятным), это стало именоваться двойным проходом (понятие чисто от комфи, так как для пользователей Автоматика это не выглядело двойным проходом).

Именно поэтому, ты не найдешь в воркфлоу на civitai отдельное обозначание для дипшринка, а вот для хайреза в Автоматике1111 (и соответственно фордж) оно всегда было с самого начала.

Погрешность сида. Ты берёшь и ролишь с дипшринком картинку и получашь годную, отрубаешь его - она кал. Что тебе мешает так же наролить годную без дипшринка? По статисттике ты будешь получать 50/50 результаты. Не обманывай себя псевдо улучшалками. Он может считаться работающем только в 100 положительных результатов в выборке.

Тоже раздражает скорость, а точнее её отсутствие, но всё же что-то эта модель умеет

>вреееети

Дура тупая, на размер глянь.

поделись воркфлоу, не совсем понял как запромтить

Да. Только ванила считается легитимной. Это всё читы.

Жаль, что пока не понятно работает ли это тема с маской

>значит ты не сидел тут с 2022 г. молокосос

Я еще в gg сидел до запила этого раздела, пидарок.

>Все деды тут знают, что хайрезфиксом всегда была галочка

>буквально два раза прогонять картинку что знает любой овощ since sd 1.3 а у каломатикошизов на это отдельная галочка и только так и не иначе, каломатикобог даровал каломатикошизам ГАЛОЧКУ, хотя там кидануть в апскейл а из апкейла в имг2имг это просто джва блядских клика

Ты диффузерсы в командной строке даже не запускал, молокосос. Сдрысни нах в б парашу, залетуха.

сдирдатганкалхуйврот кто советовал его - дебил, хуита делающая пластик, наверное для любителей понипоноса, хртьфу нах

>Лучше сделать нормальную картинку

Вот оно как раз и не получается. Мне бы хотя бы допрыгнуть до результата, которого удавалось добиться на цивите. Я слишком тупой, но красивые картинки люблю...

Первый пик с цивита, второй локально, третий цивит с хайрез фиксом. Все настройки максимально приближены. Чекпоинт, сид, лоры, весы лор, сэмплы, а вот с сэмплером не понял. На цивите какой-то eualer a, а в комфи просто euler. Буду доволен как слон, если хотя бы до уровня цивита с хайрез фиксом доползу, что-то более ебучее для меня уже излишек, готов кушать дешёвые каки.

Эээ. То есть у тебя оно тоже нихуя не делает?

О, теперь паззл сложился, пойду пробовать.

Блядь, я долбоёб, скинул пик 512 на 512

но на 1024 там такая же залупа

>Я еще в gg сидел до запила этого раздела, пидарок.

Я блять помню дедов и говно, поэтому ты по умолчанию проиграл.

А еще я помню, как комфи запилил отдельный репозитории под примеры, только из-за того, что люди не понимали как "сделать как у A1111".

>кидануть в апскейл а из апкейла в имг2имг это просто джва блядских клика

При этом при переходе на cumfy на том же реддите тонны постов на тему, как "воспроизвести" hires.fix как в Automatic1111

https://www.reddit.com/r/comfyui/comments/16mwh38/im_trying_to_replicate_the_steps_of_a1111_hires/

https://www.reddit.com/r/comfyui/comments/1bxe3u6/highres_fix_like_a1111_for_comfyui/

https://www.reddit.com/r/comfyui/comments/16gqoh1/hires_fix_on_comfyui/

> самый старый но надежный метод который работает еще с 2022 года - оригинальный hires.fix

>txt2img -> up -> img2img lowered denoise

>надежный метод

>работает

Ага, работает как говно, до сих пор анимедебилы генерят одну картинку, прогоняют двухпроходкой и получают вторую другую картинку и показывают как только выиграли от этого. Боженька дал вам мокрописи для тру хайрез генов, нет хочу жрать говно.

>когда начали понимать процесс

Судя по твоему посту понимать процесс ты не начал.

>так как для пользователей Автоматика это не выглядело двойным проходом

Лоу асикю хуль.

> ты не найдешь в воркфлоу на civitai отдельное обозначание для дипшринка

Потому что дипшринк это функция даунскейл-апскейла на конкретных слоях, о таком лоуасюкишки слыхом не слыхивали сложна сложна нипанятна.

>что хайрезфиксом всегда была галочка

Ага, ведь так сложно самому перекинуть из одного таба в другой, лоуасикюшки не справляются.

>а вот для хайреза в Автоматике1111 (и соответственно фордж) оно всегда было с самого начала.

Оно всегда было везде с самого начала, шиз.

Откуда у тебя вообще пики 512х512, нахуй ты их создаешь, если минималка это 1024?

>Эээ. То есть у тебя оно тоже нихуя не делает?

>1080x1920 ген

>без шринка и раунета начинаются мутанты

Нихуя себе ты тупой.

>На цивите какой-то eualer a, а в комфи просто euler.

Как все печально в этом вашем комфи, даже еулер а нет.

>Я блять помню дедов и говно

И галочку очевидно, на большее запомнить у тебя сингл извилины нехватает.

>только из-за того, что люди не понимали как "сделать как у A1111".

>на том же реддите тонны постов на тему, как "воспроизвести" hires.fix как в Automatic1111

Вот что каломатик с людьми делает, не понимают базовых вещей и делают сось глоть. А если бы изначально понимали принципы работы то таких вопросов не было бы.

Шо с ебалом факас?

>Оно всегда было везде с самого начала, шиз.

Вот тут ты выдал в себе туриста.

civitai.com появился раньше чем comfyui

Я еще помню времена (а они длились достаточно долго), когда на сайте не поддерживалось отображение никаких других воркфлоу, кроме метаданных с картинок, сгенеренных в Automatic1111

И ведь целых два года, до декабря 2023 мы назвали хайрезфиксом одну вещь, а теперь им обзывают всякие дипшринки и раунеты, которые часто херово работают с широкосторонними картинками и причиндалами вроде контролнетов.

Только путаете новичков.

Под каким названием скрывается Euler a как на цивите? Или его тут таки реально нет? Или просто Euler не хуже?

>Под каким названием скрывается Euler a

Ты че прикалываешься блядь

1пик с воркфлоу для дмд, там справа сверху с 1500х на выходе после дипшринк хайрезфикс апскейла. И еще хуйни накидал ньюфагам.

анцентрал?

1й и 3й это плацепо-пердолинг и самовнушение, что одна сигм_очка кривую изменила под звёздами в тумане и стало лучше пук среньк, скачал у васянов и рад. На2м пике всё ниже юниписи такой же васянский кал. Родные семплеры у комфи такие же как и на фокусе, сосируй.

>civitai.com появился раньше чем comfyui

Ты биполярник чтоли? Причем тут цивит и комфи если ты мог еще в 2021 диффузерсы гонять вообще без всего? Или у тебя начало времен наступает после рождения каломатика только? Так ты турист получается.

>Я еще помню

Говно какое-то запоминаешь только и ГАЛОЧКУ.

>мы назвали хайрезфиксом одну вещь

Кто вы то блять? Каломатикошизы?

>которые часто херово работают с широкосторонними картинками и причиндалами вроде контролнетов.

Ну я бы на твоем месте бы вообще осторожничал с такими заявлениями, а то придет какой-нибудь профессионал 40 лвл и вставит тебе пропиздонов за скилишью.

>Только путаете новичков.

Щас пока вижу как каломатикофан защищает ГАЛОЧКУ, которая буквально имг2имг.

> одна сигм_очка

Это семплеры, далбаеб.

>фокус

А, ты факасер безмозглый, ну точно далбаеб.

Бля, а вот этот уродливый шум как на первом пике никак не пофиксить, что ли?

>1пик с воркфлоу

Хуясе ты, и не лень было... Не оценят.

Ну, крч, из всего этого срача я понял только одну вещь: Дипшринк лучше не трогать, а лучше заняться реализацией полноценного хайрезфикса. Это прогресс? Я молодец? Я обучаемый?

Как же сложно вести диалог с золотыми рыбками у которых память ограничивается двумя постами.

>Именно поэтому, ты не найдешь в воркфлоу на civitai отдельное обозначание для дипшринка, а вот для хайреза в Автоматике1111 (и соответственно фордж) оно всегда было с самого начала.

civitai.com появился раньше чем comfyui

>Ты биполярник чтоли? Причем тут цивит и комфи

Еще раз, для совсем слепых с attention span уровня пресноводных - civitai, который является куда большим прибежищем всех нейрогенераторов ставит точку на i, в вопросе о том, что является хайрезфиксом.

>Именно поэтому, ты не найдешь в воркфлоу на civitai отдельное обозначание для дипшринка, а вот для хайреза в Автоматике1111 (и соответственно фордж) оно всегда было с самого начала.

civitai.com появился раньше чем comfyui

>Ты биполярник чтоли? Причем тут цивит и комфи

Еще раз, для совсем слепых с attention span уровня пресноводных - civitai, который является куда большим прибежищем всех нейрогенераторов ставит точку на i, в вопросе о том, что является хайрезфиксом.

да

нет

Это личные обозначения чтобы не забыть что где. Не обращай внимания.

нет, ты необучаемый

данет

В голос с вашей спецолимпиады, особенно с

> Я блять помню дедов и говно, поэтому ты по умолчанию проиграл.

С дипшринком/раунетом всё равно вот такие уёбищные длинноторсовые получаются, двойной проход с нормальной моделью не перерисовывает сильно картинку, а лишь деталей добавит

>civitai, который является куда большим прибежищем всех нейрогенераторов ставит точку на i, в вопросе о том, что является хайрезфиксом

>на каком-то говносайте с женериком кто-то что-то написал